注意

点击此处下载完整示例代码

torch.nn 究竟是什么?¶

创建日期:2018 年 12 月 26 日 | 最后更新:2025 年 1 月 24 日 | 最后验证:2024 年 11 月 5 日

作者: Jeremy Howard, fast.ai。感谢 Rachel Thomas 和 Francisco Ingham。

建议以 notebook 形式而非脚本形式运行本教程。要下载 notebook (.ipynb) 文件,请点击页面顶部的链接。

PyTorch 提供了设计精良的模块和类,如 torch.nn、torch.optim、Dataset 和 DataLoader,帮助你创建和训练神经网络。为了充分利用它们的能力并根据你的问题进行定制,你需要真正理解它们到底在做什么。为了帮助你理解这一点,我们将首先在不使用这些模块的任何功能的情况下,在 MNIST 数据集上训练一个基本的神经网络;我们最初只使用最基本的 PyTorch 张量功能。然后,我们将每次增量添加 torch.nn、torch.optim、Dataset 或 DataLoader 中的一个功能,准确展示每个部分的作用,以及它是如何使代码更简洁或更灵活的。

本教程假设你已安装 PyTorch,并熟悉张量操作的基础知识。(如果你熟悉 Numpy 数组操作,你会发现此处使用的 PyTorch 张量操作几乎相同)。

MNIST 数据设置¶

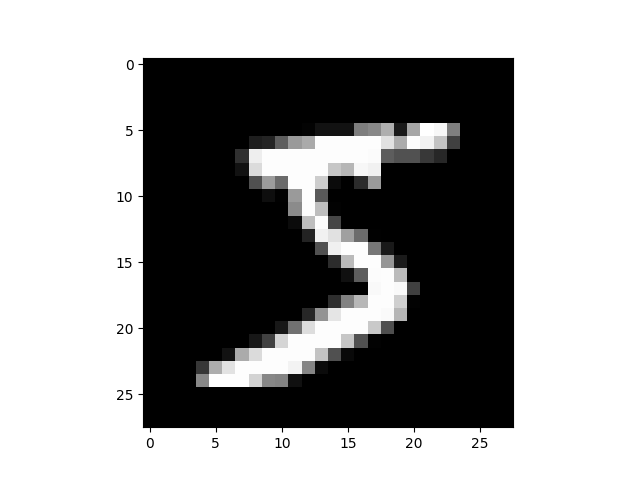

我们将使用经典的 MNIST 数据集,该数据集包含手写数字(0 到 9)的黑白图像。

我们将使用 pathlib 来处理路径(它是 Python 3 标准库的一部分),并将使用 requests 下载数据集。我们只在使用时导入模块,这样你就可以清楚地看到每一步使用了什么。

from pathlib import Path

import requests

DATA_PATH = Path("data")

PATH = DATA_PATH / "mnist"

PATH.mkdir(parents=True, exist_ok=True)

URL = "https://github.com/pytorch/tutorials/raw/main/_static/"

FILENAME = "mnist.pkl.gz"

if not (PATH / FILENAME).exists():

content = requests.get(URL + FILENAME).content

(PATH / FILENAME).open("wb").write(content)

该数据集采用 numpy 数组格式,并使用 pickle(一种 Python 特有的数据序列化格式)存储。

每张图像是 28 x 28 像素,并以长度为 784 (=28x28) 的扁平行存储。让我们看一张;我们需要先将其重塑为 2D 形式。

from matplotlib import pyplot

import numpy as np

pyplot.imshow(x_train[0].reshape((28, 28)), cmap="gray")

# ``pyplot.show()`` only if not on Colab

try:

import google.colab

except ImportError:

pyplot.show()

print(x_train.shape)

(50000, 784)

PyTorch 使用 torch.tensor 而非 numpy 数组,因此我们需要转换数据。

import torch

x_train, y_train, x_valid, y_valid = map(

torch.tensor, (x_train, y_train, x_valid, y_valid)

)

n, c = x_train.shape

print(x_train, y_train)

print(x_train.shape)

print(y_train.min(), y_train.max())

tensor([[0., 0., 0., ..., 0., 0., 0.],

[0., 0., 0., ..., 0., 0., 0.],

[0., 0., 0., ..., 0., 0., 0.],

...,

[0., 0., 0., ..., 0., 0., 0.],

[0., 0., 0., ..., 0., 0., 0.],

[0., 0., 0., ..., 0., 0., 0.]]) tensor([5, 0, 4, ..., 8, 4, 8])

torch.Size([50000, 784])

tensor(0) tensor(9)

从头开始构建神经网络(不使用 torch.nn)¶

我们首先只使用 PyTorch 张量操作创建一个模型。我们假设你已经熟悉神经网络的基础知识。(如果你不熟悉,可以在 course.fast.ai 上学习)。

PyTorch 提供了创建随机张量或全零张量的方法,我们将用它们来为简单的线性模型创建权重和偏置。这些只是常规的张量,但有一个非常特别的附加功能:我们告诉 PyTorch 它们需要计算梯度。这使得 PyTorch 会记录对该张量进行的所有操作,以便在反向传播期间自动计算梯度!

对于权重,我们在初始化之后设置 requires_grad,因为我们不希望将该步骤包含在梯度计算中。(请注意,PyTorch 中末尾带有 _ 的操作表示该操作是原地进行的)。

注意

我们在此处使用 Xavier 初始化(通过乘以 1/sqrt(n))初始化权重。

import math

weights = torch.randn(784, 10) / math.sqrt(784)

weights.requires_grad_()

bias = torch.zeros(10, requires_grad=True)

由于 PyTorch 能够自动计算梯度,我们可以使用任何标准的 Python 函数(或可调用对象)作为模型!所以我们只需编写一个简单的矩阵乘法和广播加法来创建一个简单的线性模型。我们还需要一个激活函数,因此我们将编写并使用 log_softmax。记住:尽管 PyTorch 提供了许多预先编写好的损失函数、激活函数等等,但你也可以很容易地使用纯 Python 编写自己的函数。PyTorch 甚至会自动为你的函数创建快速加速器或向量化 CPU 代码。

在上面,@ 表示矩阵乘法操作。我们将对一批数据(在本例中是 64 张图像)调用我们的函数。这是一个前向传播。请注意,在此阶段我们的预测不会比随机猜测更好,因为我们是从随机权重开始的。

bs = 64 # batch size

xb = x_train[0:bs] # a mini-batch from x

preds = model(xb) # predictions

preds[0], preds.shape

print(preds[0], preds.shape)

tensor([-2.5452, -2.0790, -2.1832, -2.6221, -2.3670, -2.3854, -2.9432, -2.4391,

-1.8657, -2.0355], grad_fn=<SelectBackward0>) torch.Size([64, 10])

如你所见,preds 张量不仅包含张量值,还包含一个梯度函数。我们稍后将用它来进行反向传播。

让我们实现负对数似然作为损失函数(同样,我们可以只使用标准 Python)

def nll(input, target):

return -input[range(target.shape[0]), target].mean()

loss_func = nll

让我们用随机模型检查一下损失,这样稍后进行反向传播后,我们就能看到是否有所改进。

tensor(2.4020, grad_fn=<NegBackward0>)

我们还实现一个函数来计算模型的准确率。对于每个预测,如果具有最大值的索引与目标值匹配,则预测是正确的。

def accuracy(out, yb):

preds = torch.argmax(out, dim=1)

return (preds == yb).float().mean()

让我们检查一下随机模型的准确率,这样我们就能看到随着损失的改善,准确率是否也有所提高。

tensor(0.0938)

现在我们可以运行训练循环了。对于每一次迭代,我们将:

选择一个 mini-batch 的数据(大小为

bs)使用模型进行预测

计算损失

loss.backward()更新模型的梯度,在此例中即weights和bias的梯度。

现在我们使用这些梯度来更新权重和偏置。我们在 torch.no_grad() 上下文管理器中执行此操作,因为我们不希望这些操作被记录下来用于下一次的梯度计算。你可以在此处阅读更多关于 PyTorch Autograd 如何记录操作的信息。

然后我们将梯度设置为零,以便为下一个循环做好准备。否则,我们的梯度将记录所有已发生操作的累积总和(即 loss.backward() 将梯度添加到已存储的值中,而不是替换它们)。

提示

你可以使用标准的 Python 调试器逐步执行 PyTorch 代码,以便在每一步检查各种变量的值。取消注释下面的 set_trace() 来尝试一下。

from IPython.core.debugger import set_trace

lr = 0.5 # learning rate

epochs = 2 # how many epochs to train for

for epoch in range(epochs):

for i in range((n - 1) // bs + 1):

# set_trace()

start_i = i * bs

end_i = start_i + bs

xb = x_train[start_i:end_i]

yb = y_train[start_i:end_i]

pred = model(xb)

loss = loss_func(pred, yb)

loss.backward()

with torch.no_grad():

weights -= weights.grad * lr

bias -= bias.grad * lr

weights.grad.zero_()

bias.grad.zero_()

就这样:我们完全从头开始创建并训练了一个最小的神经网络(在这种情况下,是一个逻辑回归,因为没有隐藏层)!

让我们检查一下损失和准确率,并与之前的结果进行比较。我们预期损失会下降,准确率会提高,结果也确实如此。

tensor(0.0813, grad_fn=<NegBackward0>) tensor(1.)

使用 torch.nn.functional¶

现在我们将重构代码,使其功能与之前相同,但开始利用 PyTorch 的 nn 类来使其更简洁和灵活。从这里开始的每一步,我们都应该使代码变得更短、更易懂和/或更灵活。

第一步也是最简单的一步是通过将手写的激活函数和损失函数替换为 torch.nn.functional 中的函数来缩短代码(通常约定将其导入到 F 命名空间)。该模块包含 torch.nn 库中的所有函数(而库的其他部分包含类)。除了各种损失函数和激活函数外,你还可以在这里找到一些方便创建神经网络的函数,例如池化函数。(还有用于卷积、线性层等的函数,但正如我们将看到的,这些通常使用库的其他部分来处理会更好)。

如果你使用负对数似然损失和 log softmax 激活函数,那么 PyTorch 提供了一个将两者结合的单个函数 F.cross_entropy。因此我们甚至可以从模型中移除激活函数。

import torch.nn.functional as F

loss_func = F.cross_entropy

def model(xb):

return xb @ weights + bias

请注意,我们在 model 函数中不再调用 log_softmax。让我们确认损失和准确率与之前相同

tensor(0.0813, grad_fn=<NllLossBackward0>) tensor(1.)

使用 nn.Module 重构¶

接下来,我们将使用 nn.Module 和 nn.Parameter,以实现更清晰和简洁的训练循环。我们继承 nn.Module(它本身是一个类,能够跟踪状态)。在此例中,我们想创建一个类来保存我们的权重、偏置和前向传播的方法。nn.Module 拥有许多属性和方法(例如 .parameters() 和 .zero_grad()),我们将使用它们。

注意

nn.Module(大写 M)是 PyTorch 特有的概念,是我们经常会使用的一个类。nn.Module 不要与 Python 中(小写 m)module 的概念混淆,后者是一个可以导入的 Python 代码文件。

from torch import nn

class Mnist_Logistic(nn.Module):

def __init__(self):

super().__init__()

self.weights = nn.Parameter(torch.randn(784, 10) / math.sqrt(784))

self.bias = nn.Parameter(torch.zeros(10))

def forward(self, xb):

return xb @ self.weights + self.bias

既然我们现在使用对象而不是仅仅使用函数,我们首先需要实例化我们的模型

model = Mnist_Logistic()

现在我们可以像之前一样计算损失。注意 nn.Module 对象的使用方式就像它们是函数一样(也就是说它们是可调用的),但 PyTorch 会在幕后自动调用我们的 forward 方法。

tensor(2.3096, grad_fn=<NllLossBackward0>)

之前在我们的训练循环中,我们必须按名称更新每个参数的值,并手动单独将每个参数的梯度归零,就像这样

with torch.no_grad():

weights -= weights.grad * lr

bias -= bias.grad * lr

weights.grad.zero_()

bias.grad.zero_()

现在我们可以利用 model.parameters() 和 model.zero_grad()(两者都由 PyTorch 为 nn.Module 定义)来使这些步骤更简洁,并且更不容易忘记某些参数,特别是在模型更复杂的情况下

with torch.no_grad():

for p in model.parameters(): p -= p.grad * lr

model.zero_grad()

我们将我们的这个小训练循环封装在一个 fit 函数中,以便之后可以再次运行它。

def fit():

for epoch in range(epochs):

for i in range((n - 1) // bs + 1):

start_i = i * bs

end_i = start_i + bs

xb = x_train[start_i:end_i]

yb = y_train[start_i:end_i]

pred = model(xb)

loss = loss_func(pred, yb)

loss.backward()

with torch.no_grad():

for p in model.parameters():

p -= p.grad * lr

model.zero_grad()

fit()

让我们再次确认损失已经下降了

tensor(0.0821, grad_fn=<NllLossBackward0>)

使用 nn.Linear 重构¶

我们继续重构代码。不再手动定义和初始化 self.weights 和 self.bias,以及计算 xb @ self.weights + self.bias,而是将使用 PyTorch 的类 nn.Linear 来表示一个线性层,它会为我们完成所有这些工作。PyTorch 有许多预定义的层,可以极大地简化代码,而且通常也会更快。

我们像之前一样实例化模型并计算损失

model = Mnist_Logistic()

print(loss_func(model(xb), yb))

tensor(2.3313, grad_fn=<NllLossBackward0>)

我们仍然可以使用和之前一样的 fit 方法。

tensor(0.0819, grad_fn=<NllLossBackward0>)

使用 torch.optim 重构¶

PyTorch 还有一个包含各种优化算法的包,即 torch.optim。我们可以使用优化器的 step 方法来执行前进一步(更新参数),而不是手动更新每个参数。

这将允许我们替换之前手动编写的优化步骤

with torch.no_grad():

for p in model.parameters(): p -= p.grad * lr

model.zero_grad()

而只需使用

(optim.zero_grad() 将梯度重置为 0,我们需要在计算下一个 minibatch 的梯度之前调用它。)

from torch import optim

我们将定义一个小函数来创建模型和优化器,以便将来可以重用。

def get_model():

model = Mnist_Logistic()

return model, optim.SGD(model.parameters(), lr=lr)

model, opt = get_model()

print(loss_func(model(xb), yb))

for epoch in range(epochs):

for i in range((n - 1) // bs + 1):

start_i = i * bs

end_i = start_i + bs

xb = x_train[start_i:end_i]

yb = y_train[start_i:end_i]

pred = model(xb)

loss = loss_func(pred, yb)

loss.backward()

opt.step()

opt.zero_grad()

print(loss_func(model(xb), yb))

tensor(2.2659, grad_fn=<NllLossBackward0>)

tensor(0.0810, grad_fn=<NllLossBackward0>)

使用 Dataset 重构¶

PyTorch 有一个抽象的 Dataset 类。Dataset 可以是任何具有 __len__ 函数(由 Python 标准的 len 函数调用)和 __getitem__ 函数(作为索引访问方式)的对象。本教程提供了一个很好的示例,介绍了如何创建一个继承自 Dataset 的自定义 FacialLandmarkDataset 类。

PyTorch 的 TensorDataset 是一个封装张量的 Dataset。通过定义长度和索引方式,这也提供了一种沿张量第一个维度进行迭代、索引和切片的方法。这将使我们在训练时更容易在同一行中访问自变量和因变量。

from torch.utils.data import TensorDataset

x_train 和 y_train 都可以合并到一个 TensorDataset 中,这样迭代和切片会更容易。

之前,我们必须单独迭代 x 和 y 值的 minibatches

现在,我们可以同时执行这两步

tensor(0.0826, grad_fn=<NllLossBackward0>)

使用 DataLoader 重构¶

PyTorch 的 DataLoader 负责管理 batch。你可以从任何 Dataset 创建一个 DataLoader。DataLoader 使迭代 batch 更加容易。不再需要使用 train_ds[i*bs : i*bs+bs],DataLoader 会自动提供每个 minibatch。

from torch.utils.data import DataLoader

train_ds = TensorDataset(x_train, y_train)

train_dl = DataLoader(train_ds, batch_size=bs)

之前,我们的循环是这样迭代 batch (xb, yb) 的

现在,我们的循环更简洁了,因为 (xb, yb) 会自动从数据加载器中加载

tensor(0.0818, grad_fn=<NllLossBackward0>)

感谢 PyTorch 的 nn.Module、nn.Parameter、Dataset 和 DataLoader,我们的训练循环现在变得非常小且更容易理解。现在让我们尝试添加在实践中创建有效模型所需的基本功能。

添加验证¶

在第一节中,我们只是试图建立一个合理的训练循环用于训练数据。实际上,你始终应该有一个验证集,以判断是否发生了过拟合。

打乱训练数据非常重要,以防止批次之间存在相关性和过拟合。另一方面,无论我们是否打乱验证集,验证损失都将是相同的。由于打乱数据会花费额外的时间,因此打乱验证数据没有意义。

我们将对验证集使用两倍于训练集的批量大小。这是因为验证集不需要反向传播,因此占用内存较少(它不需要存储梯度)。我们利用这一点来使用更大的批量大小,从而更快地计算损失。

train_ds = TensorDataset(x_train, y_train)

train_dl = DataLoader(train_ds, batch_size=bs, shuffle=True)

valid_ds = TensorDataset(x_valid, y_valid)

valid_dl = DataLoader(valid_ds, batch_size=bs * 2)

我们将在每个训练周期(epoch)结束时计算并打印验证损失。

(请注意,我们在训练前总是调用 model.train(),在推理前调用 model.eval(),因为这些函数会被 nn.BatchNorm2d 和 nn.Dropout 等层使用,以确保它们在不同阶段的正确行为。)

model, opt = get_model()

for epoch in range(epochs):

model.train()

for xb, yb in train_dl:

pred = model(xb)

loss = loss_func(pred, yb)

loss.backward()

opt.step()

opt.zero_grad()

model.eval()

with torch.no_grad():

valid_loss = sum(loss_func(model(xb), yb) for xb, yb in valid_dl)

print(epoch, valid_loss / len(valid_dl))

0 tensor(0.3048)

1 tensor(0.2872)

创建 fit() 和 get_data()¶

现在我们将自己进行一些小的重构。由于我们计算训练集和验证集损失的过程相似,我们将其提取为一个独立的函数 loss_batch,该函数计算一个批次的损失。

对于训练集,我们传入一个优化器,并用它执行反向传播。对于验证集,我们不传入优化器,因此该方法不执行反向传播。

fit 运行必要的运算来训练模型并计算每个训练周期的训练损失和验证损失。

import numpy as np

def fit(epochs, model, loss_func, opt, train_dl, valid_dl):

for epoch in range(epochs):

model.train()

for xb, yb in train_dl:

loss_batch(model, loss_func, xb, yb, opt)

model.eval()

with torch.no_grad():

losses, nums = zip(

*[loss_batch(model, loss_func, xb, yb) for xb, yb in valid_dl]

)

val_loss = np.sum(np.multiply(losses, nums)) / np.sum(nums)

print(epoch, val_loss)

get_data 返回用于训练集和验证集的数据加载器 (dataloaders)。

def get_data(train_ds, valid_ds, bs):

return (

DataLoader(train_ds, batch_size=bs, shuffle=True),

DataLoader(valid_ds, batch_size=bs * 2),

)

现在,我们获取数据加载器并拟合模型的整个过程可以通过 3 行代码完成

0 0.29393543709516523

1 0.3258970961511135

您可以使用这基本的 3 行代码训练各种各样的模型。让我们看看是否可以用它们来训练一个卷积神经网络 (CNN)!

切换到 CNN¶

现在我们将构建一个包含三个卷积层的神经网络。由于上一节中的任何函数都没有对模型形式做任何假设,我们将能够使用它们来训练 CNN 而无需任何修改。

我们将使用 PyTorch 预定义的 Conv2d 类作为我们的卷积层。我们定义一个具有 3 个卷积层的 CNN。每个卷积后面都跟着一个 ReLU。最后,我们执行平均池化(average pooling)。(注意,view 是 PyTorch 中的版本,对应于 Numpy 的 reshape)

class Mnist_CNN(nn.Module):

def __init__(self):

super().__init__()

self.conv1 = nn.Conv2d(1, 16, kernel_size=3, stride=2, padding=1)

self.conv2 = nn.Conv2d(16, 16, kernel_size=3, stride=2, padding=1)

self.conv3 = nn.Conv2d(16, 10, kernel_size=3, stride=2, padding=1)

def forward(self, xb):

xb = xb.view(-1, 1, 28, 28)

xb = F.relu(self.conv1(xb))

xb = F.relu(self.conv2(xb))

xb = F.relu(self.conv3(xb))

xb = F.avg_pool2d(xb, 4)

return xb.view(-1, xb.size(1))

lr = 0.1

动量 (Momentum) 是随机梯度下降的一种变体,它也会考虑之前的更新,通常能带来更快的训练速度。

0 0.3646130460739136

1 0.26228193019628526

使用 nn.Sequential¶

torch.nn 还有另一个方便的类可以简化我们的代码:Sequential。 Sequential 对象按顺序运行其中包含的每个模块。这是一种编写神经网络更简单的方式。

为了利用这一点,我们需要能够轻松地从给定的函数定义一个**自定义层 (custom layer)**。例如,PyTorch 没有 `view` 层,我们需要为我们的网络创建一个。 Lambda 将创建一个层,我们可以在使用 Sequential 定义网络时使用它。

class Lambda(nn.Module):

def __init__(self, func):

super().__init__()

self.func = func

def forward(self, x):

return self.func(x)

def preprocess(x):

return x.view(-1, 1, 28, 28)

使用 Sequential 创建的模型很简单

model = nn.Sequential(

Lambda(preprocess),

nn.Conv2d(1, 16, kernel_size=3, stride=2, padding=1),

nn.ReLU(),

nn.Conv2d(16, 16, kernel_size=3, stride=2, padding=1),

nn.ReLU(),

nn.Conv2d(16, 10, kernel_size=3, stride=2, padding=1),

nn.ReLU(),

nn.AvgPool2d(4),

Lambda(lambda x: x.view(x.size(0), -1)),

)

opt = optim.SGD(model.parameters(), lr=lr, momentum=0.9)

fit(epochs, model, loss_func, opt, train_dl, valid_dl)

0 0.3330025281429291

1 0.22993727023601532

封装 DataLoader¶

- 我们的 CNN 相当简洁,但它只能用于 MNIST 数据集,因为

它假设输入是 28*28 的长向量

它假设最终的 CNN 网格大小是 4*4(因为这是我们使用的平均池化核大小)

让我们摆脱这两个假设,这样我们的模型就能适用于任何 2d 单通道图像。首先,我们可以通过将数据预处理移入生成器来移除最初的 Lambda 层

def preprocess(x, y):

return x.view(-1, 1, 28, 28), y

class WrappedDataLoader:

def __init__(self, dl, func):

self.dl = dl

self.func = func

def __len__(self):

return len(self.dl)

def __iter__(self):

for b in self.dl:

yield (self.func(*b))

train_dl, valid_dl = get_data(train_ds, valid_ds, bs)

train_dl = WrappedDataLoader(train_dl, preprocess)

valid_dl = WrappedDataLoader(valid_dl, preprocess)

接下来,我们可以用 nn.AdaptiveAvgPool2d 替换 nn.AvgPool2d,这允许我们定义我们想要的*输出*张量大小,而不是我们拥有的*输入*张量大小。因此,我们的模型将适用于任何大小的输入。

model = nn.Sequential(

nn.Conv2d(1, 16, kernel_size=3, stride=2, padding=1),

nn.ReLU(),

nn.Conv2d(16, 16, kernel_size=3, stride=2, padding=1),

nn.ReLU(),

nn.Conv2d(16, 10, kernel_size=3, stride=2, padding=1),

nn.ReLU(),

nn.AdaptiveAvgPool2d(1),

Lambda(lambda x: x.view(x.size(0), -1)),

)

opt = optim.SGD(model.parameters(), lr=lr, momentum=0.9)

我们来试试看

0 0.3212135115623474

1 0.21439074140787123

使用您的加速器 (Accelerator)¶

如果您足够幸运,能够访问 CUDA 等加速器(您可以以约 0.50 美元/小时的价格从大多数云服务提供商那里租用),您可以使用它来加速您的代码。首先检查您的加速器是否在 Pytorch 中工作正常

# If the current accelerator is available, we will use it. Otherwise, we use the CPU.

device = torch.accelerator.current_accelerator().type if torch.accelerator.is_available() else "cpu"

print(f"Using {device} device")

Using cuda device

让我们更新 preprocess 函数,将批次数据移动到加速器上

最后,我们可以将模型移动到加速器上。

model.to(device)

opt = optim.SGD(model.parameters(), lr=lr, momentum=0.9)

您应该会发现现在运行得更快了

0 0.1786795982837677

1 0.16877726690769196

结束语¶

现在我们有了一个通用的数据管道和训练循环,您可以使用它来训练多种类型的 PyTorch 模型。想看看现在训练模型有多简单,请查看 mnist_sample notebook。

当然,还有许多您想要添加的功能,例如数据增强、超参数调优、训练监控、迁移学习等等。这些功能在 fastai 库中都可用,该库是按照本教程中展示的设计方法开发的,为希望进一步提升模型的实践者提供了自然的下一步。

在本教程开始时,我们承诺将通过示例解释 torch.nn、torch.optim、Dataset 和 DataLoader。现在我们总结一下我们所学到的

torch.nn:

Module:创建一个可调用对象,其行为类似函数,但也可以包含状态(如神经网络层的权重)。它知道自己包含哪些Parameter,可以将其所有梯度清零,遍历它们进行权重更新等。

Parameter:一个张量的包装器,它告诉Module它拥有在反向传播期间需要更新的权重。只有设置了 `requires_grad` 属性的张量才会被更新

functional:一个模块(通常按惯例导入到F命名空间中),包含激活函数、损失函数等,以及卷积层和线性层等无状态版本的层。

torch.optim:包含优化器,例如SGD,它们在反向传播步骤中更新Parameter的权重

Dataset:具有__len__和__getitem__方法的对象的抽象接口,包括 PyTorch 提供的类,如TensorDataset

DataLoader:接受任何Dataset并创建一个迭代器,该迭代器返回批次数据。

脚本总运行时间: ( 0 分 25.546 秒)