构建 ExecuTorch Android 演示应用程序¶

这是从 PyTorch Android Demo App 分叉出来的。

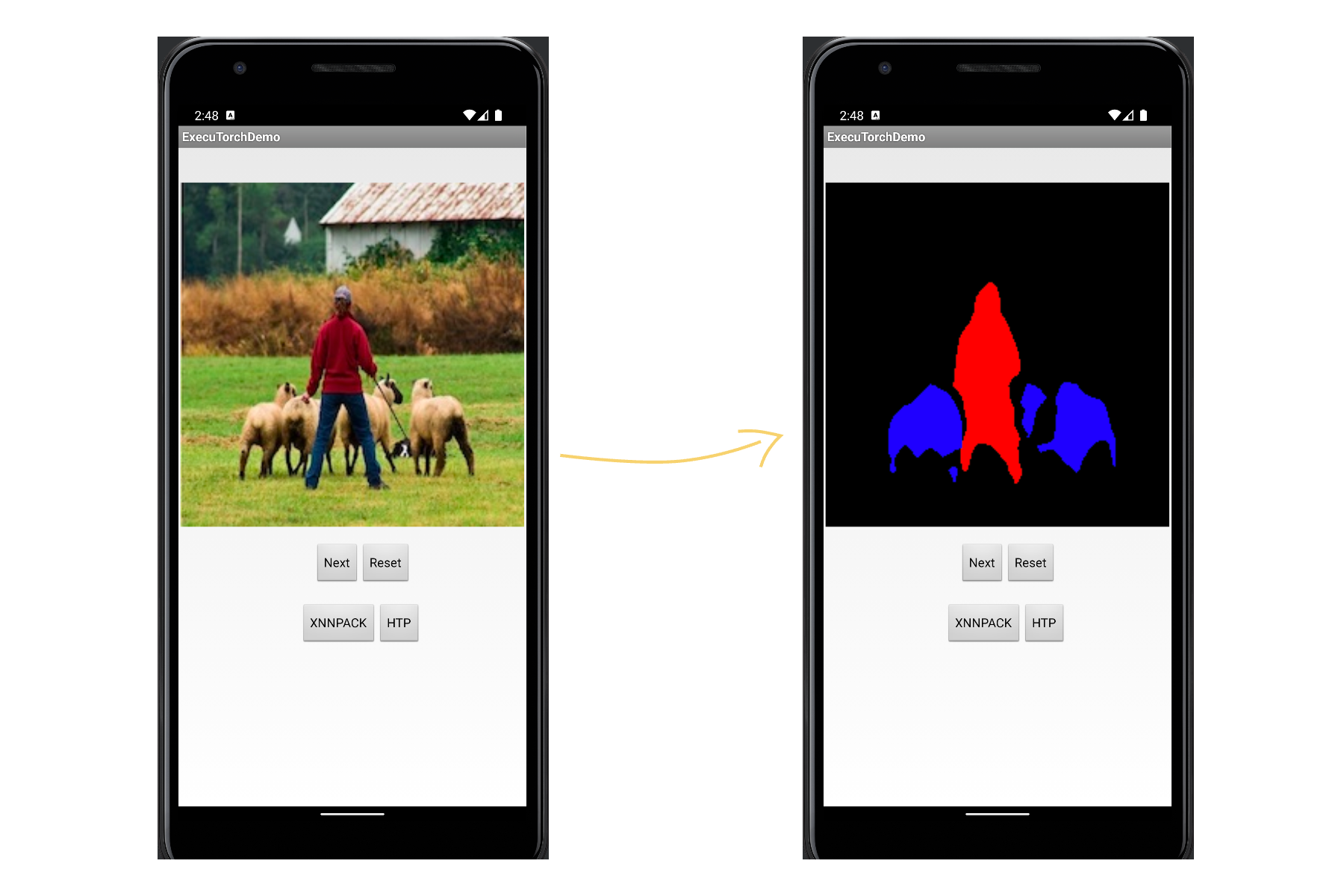

本指南介绍了如何使用演示应用程序为 Android 设置 ExecuTorch。该应用程序采用 DeepLab v3 模型进行图像分割任务。模型使用 XNNPACK FP32 后端 导出到 ExecuTorch。

如何为 Android arm64-v8a 设置构建目标

如何使用 JNI 封装器为 Android 构建所需的 ExecuTorch 运行时

如何使用所需的 JNI 库和模型文件构建应用程序

请参阅 设置 ExecuTorch 以设置仓库和开发环境。

下载并安装 Android Studio 和 SDK。

支持的主机操作系统:CentOS、macOS Ventura (M1/x86_64)。有关 Qualcomm HTP 的具体要求,请参见下文。

仅限 Qualcomm HTP1: 要在 Qualcomm 的 AI Engine Direct 上构建和运行,请遵循 使用 Qualcomm AI Engine Direct 后端构建和运行 ExecuTorch 了解硬件和软件先决条件。本教程中我们使用的版本是 2.19。本教程中我们使用的芯片是 SM8450。

注意

此演示应用程序和教程仅已使用 arm64-v8a ABI 进行了验证。

构建¶

预先 (Ahead-Of-Time)¶

我们在 Android 演示应用程序中为 ExecuTorch 运行时生成模型文件。

XNNPACK 委托¶

为了将 DeepLab v3 委托给 XNNPACK 后端,请执行以下操作导出模型

python3 -m examples.xnnpack.aot_compiler --model_name="dl3" --delegate

mkdir -p examples/demo-apps/android/ExecuTorchDemo/app/src/main/assets/

cp dl3_xnnpack_fp32.pte examples/demo-apps/android/ExecuTorchDemo/app/src/main/assets/

有关降低到 XNNPACK 的更详细教程,请参阅 XNNPACK 后端。

运行时¶

我们构建所需的 ExecuTorch 运行时库来运行模型。

XNNPACK¶

使用 XNNPACK 后端构建库的 CMake 目标

export ANDROID_NDK=<path-to-android-ndk>

export ANDROID_ABI=arm64-v8a

# Run the following lines from the `executorch/` folder

./install_requirements.sh --clean

mkdir cmake-android-out

# Build the core executorch library

cmake . -DCMAKE_INSTALL_PREFIX=cmake-android-out \

-DCMAKE_TOOLCHAIN_FILE="${ANDROID_NDK}/build/cmake/android.toolchain.cmake" \

-DANDROID_ABI="${ANDROID_ABI}" \

-DEXECUTORCH_BUILD_XNNPACK=ON \

-DEXECUTORCH_BUILD_EXTENSION_DATA_LOADER=ON \

-DEXECUTORCH_BUILD_EXTENSION_MODULE=ON \

-DEXECUTORCH_BUILD_EXTENSION_RUNNER_UTIL=ON \

-DEXECUTORCH_BUILD_EXTENSION_TENSOR=ON \

-Bcmake-android-out

cmake --build cmake-android-out -j16 --target install

当我们设置 EXECUTORCH_BUILD_XNNPACK=ON 时,我们将构建目标 xnnpack_backend,该目标反过来通过 CMake 链接到 libexecutorch_jni 中。

构建 Android 扩展

# Build the android extension

cmake extension/android \

-DCMAKE_TOOLCHAIN_FILE="${ANDROID_NDK}"/build/cmake/android.toolchain.cmake \

-DANDROID_ABI="${ANDROID_ABI}" \

-DCMAKE_INSTALL_PREFIX=cmake-android-out \

-Bcmake-android-out/extension/android

cmake --build cmake-android-out/extension/android -j16

libexecutorch_jni.so 封装了来自 xnnpack_backend 的所需 XNNPACK 后端运行时库,并使用 fbjni 添加了一个额外的 JNI 层。稍后,这将被公开给 Java 应用程序。

Qualcomm Hexagon NPU¶

使用 Qualcomm Hexagon NPU (HTP) 后端(也包括 XNNPACK)构建库的 CMake 目标

export ANDROID_NDK=<path-to-android-ndk>

export ANDROID_ABI=arm64-v8a

export QNN_SDK_ROOT=<path-to-qnn-sdk>

./install_requirements.sh --clean

mkdir cmake-android-out

cmake . -DCMAKE_INSTALL_PREFIX=cmake-android-out \

-DCMAKE_TOOLCHAIN_FILE="${ANDROID_NDK}/build/cmake/android.toolchain.cmake" \

-DANDROID_ABI="${ANDROID_ABI}" \

-DEXECUTORCH_BUILD_XNNPACK=ON \

-DEXECUTORCH_BUILD_QNN=ON \

-DQNN_SDK_ROOT="${QNN_SDK_ROOT}" \

-DEXECUTORCH_BUILD_EXTENSION_DATA_LOADER=ON \

-DEXECUTORCH_BUILD_EXTENSION_MODULE=ON \

-DEXECUTORCH_BUILD_EXTENSION_RUNNER_UTIL=ON \

-DEXECUTORCH_BUILD_EXTENSION_TENSOR=ON \

-Bcmake-android-out

cmake --build cmake-android-out -j16 --target install

与 XNNPACK 库类似,通过此设置,我们编译 libexecutorch_jni.so,但它添加了一个额外的静态库 qnn_executorch_backend,该库封装了 Qualcomm HTP 运行时库并注册了 Qualcomm HTP 后端。稍后,这将被公开给 Java 应用程序。

当我们启用 CMake 选项 EXECUTORCH_BUILD_QNN 时,将构建 qnn_executorch_backend。它将包含来自 backends/qualcomm 的 CMakeLists.txt,我们在其中 add_library(qnn_executorch_backend STATIC)。

构建 Android 扩展

cmake extension/android \

-DCMAKE_TOOLCHAIN_FILE="${ANDROID_NDK}"/build/cmake/android.toolchain.cmake \

-DANDROID_ABI="${ANDROID_ABI}" \

-DCMAKE_INSTALL_PREFIX=cmake-android-out \

-Bcmake-android-out/extension/android

cmake --build cmake-android-out/extension/android -j16

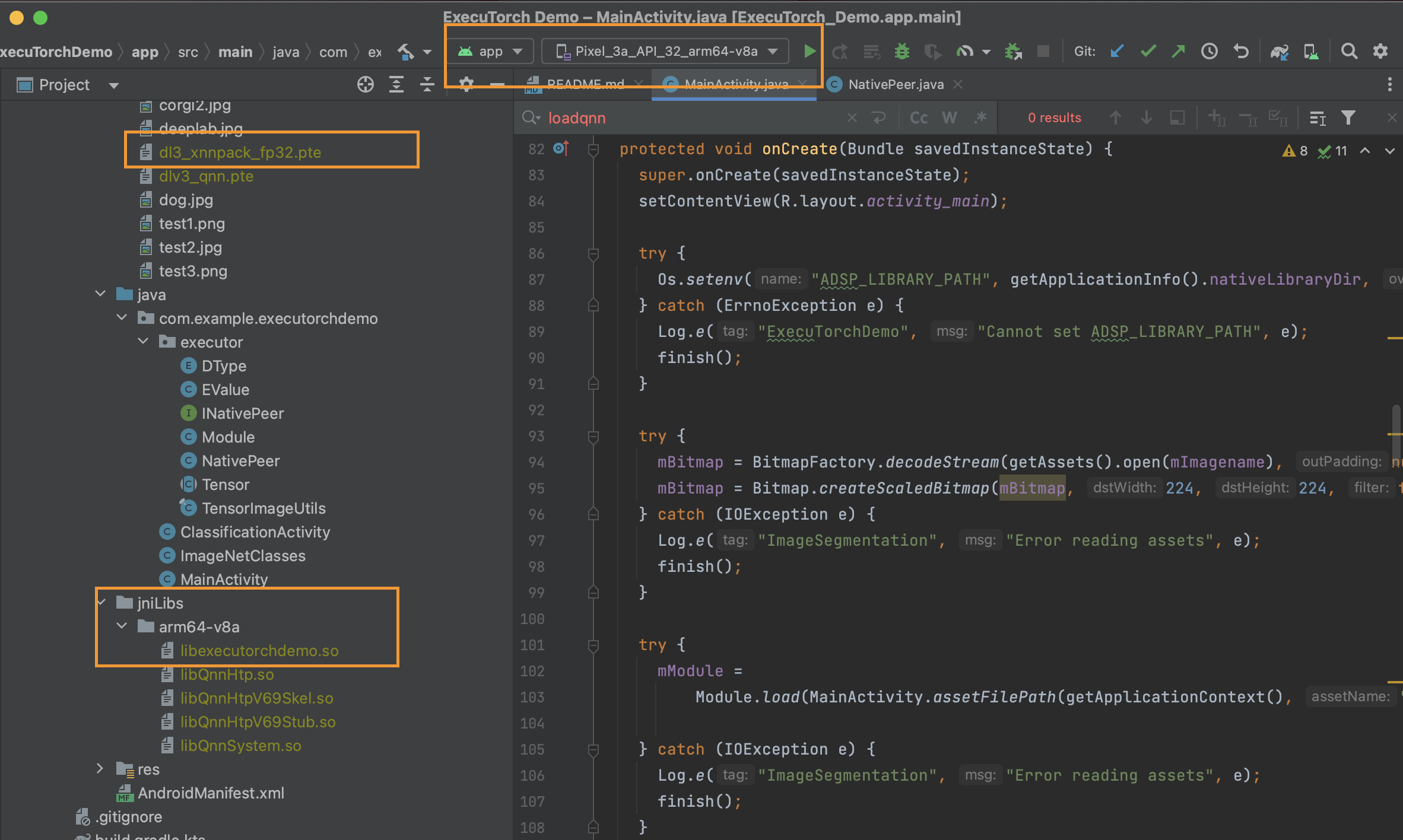

通过演示应用程序在设备上部署¶

通过 XNNPACK 部署模型的步骤¶

mkdir -p examples/demo-apps/android/ExecuTorchDemo/app/src/main/jniLibs/arm64-v8a

cp cmake-android-out/extension/android/libexecutorch_jni.so \

examples/demo-apps/android/ExecuTorchDemo/app/src/main/jniLibs/arm64-v8a/libexecutorch.so

这允许 Android 应用程序加载带有 XNNPACK 后端的 ExecuTorch 运行时作为 JNI 库。稍后,此共享库将由 Java 代码中的 NativePeer.java 加载。

通过 Qualcomm 的 AI Engine Direct 部署模型的步骤¶

mkdir -p ../examples/demo-apps/android/ExecuTorchDemo/app/src/main/jniLibs/arm64-v8a

我们需要将一些额外的 Qualcomm HTP 后端库推送到应用程序。请参阅此处的 Qualcomm 文档。

cp ${QNN_SDK_ROOT}/lib/aarch64-android/libQnnHtp.so ${QNN_SDK_ROOT}/lib/hexagon-v69/unsigned/libQnnHtpV69Skel.so ${QNN_SDK_ROOT}/lib/aarch64-android/libQnnHtpV69Stub.so ${QNN_SDK_ROOT}/lib/aarch64-android/libQnnSystem.so \

examples/demo-apps/android/ExecuTorchDemo/app/src/main/jniLibs/arm64-v8a

复制核心库

cp cmake-android-out/extension/android/libexecutorch_jni.so \

examples/demo-apps/android/ExecuTorchDemo/app/src/main/jniLibs/arm64-v8a/libexecutorch.so

cp cmake-android-out/lib/libqnn_executorch_backend.so \

examples/demo-apps/android/ExecuTorchDemo/app/src/main/jniLibs/arm64-v8a/libqnn_executorch_backend.so

运行应用程序¶

使用 Android Studio 打开项目

examples/demo-apps/android/ExecuTorchDemo。运行 应用程序 (^R)。

在手机或模拟器上,您可以尝试运行模型:

要点¶

通过本教程,我们学习了如何构建带有 XNNPACK(或 Qualcomm HTP)后端的 ExecuTorch 运行时库,并将其公开到 JNI 层以构建运行分割模型的 Android 应用程序。