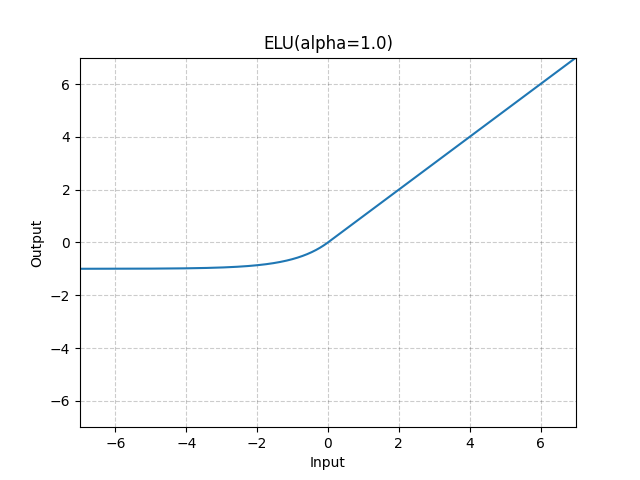

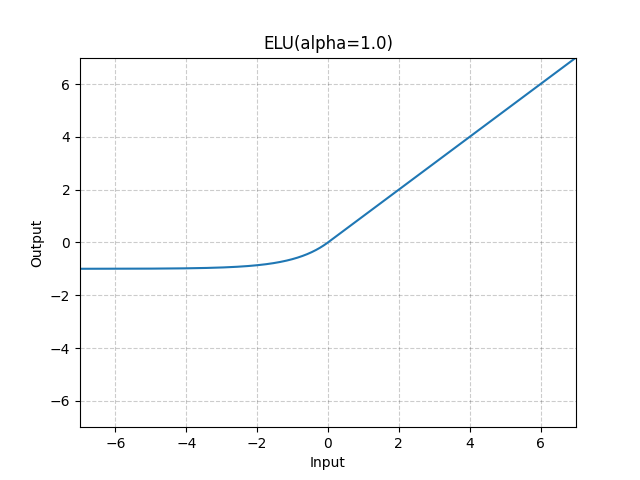

ELU¶

- class torch.nn.ELU(alpha=1.0, inplace=False)[source][source]¶

逐元素应用指数线性单元(ELU)函数。

该方法在以下论文中描述:通过指数线性单元(ELU)实现快速准确的深度网络学习。

ELU 的定义如下:

- 形状

输入:,其中 表示任意维数。

输出:,与输入形状相同。

示例

>>> m = nn.ELU() >>> input = torch.randn(2) >>> output = m(input)

逐元素应用指数线性单元(ELU)函数。

该方法在以下论文中描述:通过指数线性单元(ELU)实现快速准确的深度网络学习。

ELU 的定义如下:

输入:,其中 表示任意维数。

输出:,与输入形状相同。

示例

>>> m = nn.ELU()

>>> input = torch.randn(2)

>>> output = m(input)