注意

点击 这里 下载完整的示例代码

学习基础知识 || 快速入门 || 张量 || 数据集和数据加载器 || 转换 || 构建模型 || Autograd || 优化 || 保存和加载模型

使用 torch.autograd 进行自动微分¶

在训练神经网络时,最常用的算法是 **反向传播**。在这个算法中,参数(模型权重)会根据损失函数关于给定参数的 **梯度** 进行调整。

为了计算这些梯度,PyTorch 提供了一个内置的微分引擎,称为 torch.autograd。它支持对任何计算图进行梯度的自动计算。

考虑最简单的单层神经网络,它具有输入 x、参数 w 和 b 以及一些损失函数。它可以在 PyTorch 中以以下方式定义

张量、函数和计算图¶

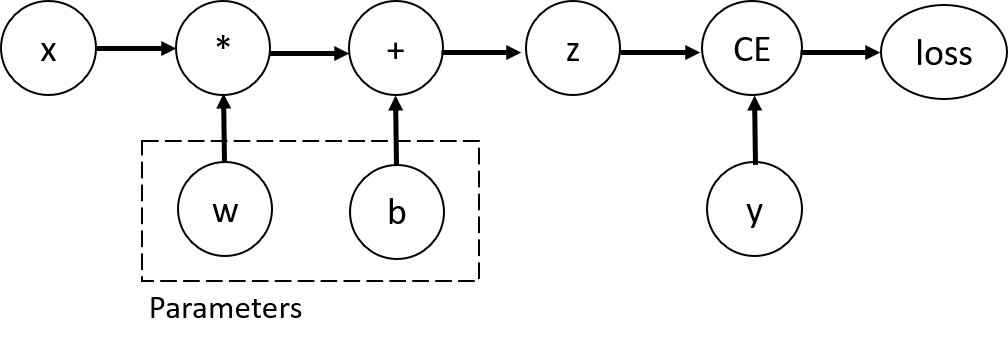

此代码定义了以下 **计算图**

在这个网络中,w 和 b 是 **参数**,我们需要对其进行优化。因此,我们需要能够计算损失函数关于这些变量的梯度。为了做到这一点,我们将这些张量的 requires_grad 属性设置为 True。

注意

您可以在创建张量时设置 requires_grad 的值,或者稍后使用 x.requires_grad_(True) 方法设置。

我们应用于张量以构建计算图的函数实际上是 Function 类的对象。此对象知道如何在 *正向* 方向上计算函数,以及如何在 *反向传播* 过程中计算其导数。对反向传播函数的引用存储在张量的 grad_fn 属性中。您可以在 Function 中找到更多信息 在文档中。

计算梯度¶

为了优化神经网络中参数的权重,我们需要计算损失函数关于参数的导数,即,我们需要 \(\frac{\partial loss}{\partial w}\) 和 \(\frac{\partial loss}{\partial b}\) 在 x 和 y 的一些固定值下。为了计算这些导数,我们调用 loss.backward(),然后从 w.grad 和 b.grad 中检索值。

注意

- 我们只能获得计算图的叶节点的

grad属性,这些节点的requires_grad属性设置为True。对于图中的所有其他节点,梯度将不可用。 - 出于性能方面的考虑,我们只能在给定图上使用

backward对其执行一次梯度计算。如果我们需要在同一图上执行多次backward调用,则需要将retain_graph=True传递给backward调用。

禁用梯度跟踪¶

默认情况下,所有具有 requires_grad=True 的张量都会跟踪它们的计算历史记录并支持梯度计算。但是,在某些情况下,我们不需要这样做,例如,当我们已经训练了模型,只是想将其应用于一些输入数据时,即我们只想对网络进行 *正向* 计算。我们可以通过将计算代码包含在 torch.no_grad() 块中来停止跟踪计算。

实现相同结果的另一种方法是在张量上使用 detach() 方法

- 您可能希望禁用梯度跟踪的原因

- 将神经网络中的某些参数标记为 **冻结参数**。这对于 微调预训练网络 来说是一个非常常见的场景。

- 当您只进行正向传递时,**加速计算**,因为对不跟踪梯度的张量进行的计算会更有效率。

关于计算图的更多信息¶

从概念上讲,autograd 会记录数据(张量)和所有执行的操作(以及生成的新的张量)在一个有向无环图 (DAG) 中,该图由 Function 对象组成。在这个 DAG 中,叶子是输入张量,根是输出张量。通过从根到叶跟踪此图,您可以使用链式法则自动计算梯度。

在正向传递中,autograd 会同时做两件事

- 运行请求的操作以计算结果张量

- 在 DAG 中维护操作的 *梯度函数*。

当 DAG 根上调用 .backward() 时,反向传递开始。然后 autograd 会

- 从每个

.grad_fn计算梯度, - 将它们累加到相应的张量的

.grad属性中 - 使用链式法则,一直传播到叶张量。

注意

**PyTorch 中的 DAG 是动态的** 需要注意的重要一点是,该图是从头开始重建的;在每次 .backward() 调用之后,autograd 会开始填充一个新的图。这正是允许您在模型中使用控制流语句的原因;您可以在需要时更改每次迭代的形状、大小和操作。

可选阅读:张量梯度和雅可比积¶

在许多情况下,我们有一个标量损失函数,我们需要计算它关于某些参数的梯度。然而,也存在输出函数是任意张量的情况。在这种情况下,PyTorch 允许您计算所谓的 **雅可比乘积**,而不是实际的梯度。

对于一个向量函数 \(\vec{y}=f(\vec{x})\),其中 \(\vec{x}=\langle x_1,\dots,x_n\rangle\) 且 \(\vec{y}=\langle y_1,\dots,y_m\rangle\),\(\vec{y}\) 关于 \(\vec{x}\) 的梯度由 **雅可比矩阵** 给出

PyTorch 不直接计算雅可比矩阵本身,而是允许您计算给定输入向量 \(v=(v_1 \dots v_m)\) 的 **雅可比乘积** \(v^T\cdot J\)。这可以通过调用带有 \(v\) 作为参数的 backward 来实现。 \(v\) 的大小应与我们想要计算乘积的原始张量的大小相同。

注意,当我们第二次使用相同的参数调用 backward 时,梯度的值是不同的。这是因为在进行 backward 传播时,PyTorch **累积梯度**,即计算出的梯度的值将添加到计算图所有叶节点的 grad 属性中。如果您想计算正确的梯度,您需要在之前将 grad 属性清零。在实际训练中,优化器 会帮我们做这件事。

注意

之前我们是在没有参数的情况下调用 backward() 函数的。这实际上等同于调用 backward(torch.tensor(1.0)),这对于计算标量值函数(如神经网络训练中的损失)的梯度是一种有效的方法。