使用 LoRA 微调 Llama2¶

本指南将教您关于 LoRA,一种参数高效的微调技术,并展示如何使用 torchtune 通过 LoRA 微调 Llama2 模型。如果您已经了解 LoRA 是什么,并想直接开始在 torchtune 中运行您自己的 LoRA 微调,您可以跳到 torchtune 中的 LoRA 微调范例。

LoRA 是什么以及它如何在微调期间节省内存

torchtune 中 LoRA 组件概述

如何使用 torchtune 运行 LoRA 微调

如何尝试不同的 LoRA 配置

熟悉 torchtune

确保 安装 torchtune

确保您已下载 Llama2-7B 模型权重

什么是 LoRA?¶

LoRA 是一种基于适配器的参数高效微调方法,它向神经网络的不同层添加可训练的低秩分解矩阵,然后冻结网络的其余参数。LoRA 最常应用于 Transformer 模型,在这种情况下,通常将低秩矩阵添加到每个 Transformer 层的自注意力中的一些线性投影中。

通过使用 LoRA 进行微调(而不是微调所有模型参数),由于带有梯度的参数数量大幅减少,您可以期望看到内存节省。当使用带有动量的优化器,例如 AdamW 时,您可以期望从优化器状态中看到进一步的内存节省。

注意

LoRA 内存节省主要来自于梯度和优化器状态,因此如果您的模型峰值内存出现在其 forward() 方法中,那么 LoRA 可能无法降低峰值内存。

LoRA 如何工作?¶

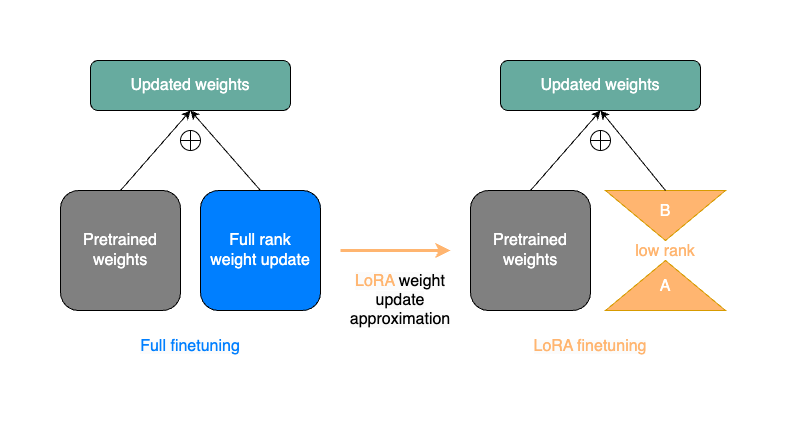

LoRA 使用低秩近似替换权重更新矩阵。一般来说,任意 nn.Linear(in_dim,out_dim) 层的权重更新的秩最高可达 min(in_dim,out_dim)。LoRA(以及其他相关论文,如 Aghajanyan 等人)假设,在 LLM 微调期间,这些更新的内在维度实际上可能要低得多。为了利用这一特性,LoRA 微调将冻结原始模型,然后从低秩投影中添加一个可训练的权重更新。更明确地说,LoRA 训练两个矩阵 A 和 B。A 将输入投影到更小的秩(实践中通常是四或八),而 B 则投影回原始线性层输出的维度。

下图简化地展示了完整微调(左侧)与使用 LoRA 的权重更新步骤(右侧)的对比。LoRA 矩阵 A 和 B 作为蓝色区域所示的满秩权重更新的近似。

虽然 LoRA 在模型的 forward() 中引入了一些额外的参数,但只有 A 和 B 矩阵是可训练的。这意味着对于秩为 r 的 LoRA 分解,我们需要存储的梯度数量从 in_dim*out_dim 减少到 r*(in_dim+out_dim)。(请记住,通常情况下,r 远小于 in_dim 和 out_dim。)

例如,在 Llama2 7B 的自注意力中,Q、K 和 V 投影的 in_dim=out_dim=4096。这意味着秩为 r=8 的 LoRA 分解将把给定投影的可训练参数数量从 \(4096 * 4096 \approx 15M\) 减少到 \(8 * 8192 \approx 65K\),减少了 99% 以上。

让我们看看 PyTorch 原生实现的最小 LoRA 示例。

import torch

from torch import nn

class LoRALinear(nn.Module):

def __init__(

self,

in_dim: int,

out_dim: int,

rank: int,

alpha: float,

dropout: float

):

# These are the weights from the original pretrained model

self.linear = nn.Linear(in_dim, out_dim, bias=False)

# These are the new LoRA params. In general rank << in_dim, out_dim

self.lora_a = nn.Linear(in_dim, rank, bias=False)

self.lora_b = nn.Linear(rank, out_dim, bias=False)

# Rank and alpha are commonly-tuned hyperparameters

self.rank = rank

self.alpha = alpha

# Most implementations also include some dropout

self.dropout = nn.Dropout(p=dropout)

# The original params are frozen, and only LoRA params are trainable.

self.linear.weight.requires_grad = False

self.lora_a.weight.requires_grad = True

self.lora_b.weight.requires_grad = True

def forward(self, x: torch.Tensor) -> torch.Tensor:

# This would be the output of the original model

frozen_out = self.linear(x)

# lora_a projects inputs down to the much smaller self.rank,

# then lora_b projects back up to the output dimension

lora_out = self.lora_b(self.lora_a(self.dropout(x)))

# Finally, scale by the alpha parameter (normalized by rank)

# and add to the original model's outputs

return frozen_out + (self.alpha / self.rank) * lora_out

这里省略了一些关于初始化的其他细节,如果您想了解更多,可以在 LoRALinear 中查看我们的实现。现在我们了解了 LoRA 的工作原理,让我们看看如何将其应用于我们喜爱的模型。

将 LoRA 应用于 Llama2 模型¶

使用 torchtune,我们可以轻松地将 LoRA 应用于具有各种不同配置的 Llama2 模型。让我们看看如何在 torchtune 中构建带或不带 LoRA 的 Llama2 模型。

from torchtune.models.llama2 import llama2_7b, lora_llama2_7b

# Build Llama2 without any LoRA layers

base_model = llama2_7b()

# The default settings for lora_llama2_7b will match those for llama2_7b

# We just need to define which layers we want LoRA applied to.

# Within each self-attention, we can choose from ["q_proj", "k_proj", "v_proj", and "output_proj"].

# We can also set apply_lora_to_mlp=True or apply_lora_to_output=True to apply LoRA to other linear

# layers outside of the self-attention.

lora_model = lora_llama2_7b(lora_attn_modules=["q_proj", "v_proj"])

注意

单独调用 lora_llama_2_7b 不会处理哪些参数是可训练的定义。有关如何操作,请参见下文。

让我们更仔细地检查一下这些模型。

# Print the first layer's self-attention in the usual Llama2 model

>>> print(base_model.layers[0].attn)

MultiHeadAttention(

(q_proj): Linear(in_features=4096, out_features=4096, bias=False)

(k_proj): Linear(in_features=4096, out_features=4096, bias=False)

(v_proj): Linear(in_features=4096, out_features=4096, bias=False)

(output_proj): Linear(in_features=4096, out_features=4096, bias=False)

(pos_embeddings): RotaryPositionalEmbeddings()

)

# Print the same for Llama2 with LoRA weights

>>> print(lora_model.layers[0].attn)

MultiHeadAttention(

(q_proj): LoRALinear(

(dropout): Dropout(p=0.0, inplace=False)

(lora_a): Linear(in_features=4096, out_features=8, bias=False)

(lora_b): Linear(in_features=8, out_features=4096, bias=False)

)

(k_proj): Linear(in_features=4096, out_features=4096, bias=False)

(v_proj): LoRALinear(

(dropout): Dropout(p=0.0, inplace=False)

(lora_a): Linear(in_features=4096, out_features=8, bias=False)

(lora_b): Linear(in_features=8, out_features=4096, bias=False)

)

(output_proj): Linear(in_features=4096, out_features=4096, bias=False)

(pos_embeddings): RotaryPositionalEmbeddings()

)

注意到我们的 LoRA 模型层在 Q 和 V 投影中包含了额外的权重,正如预期一样。此外,检查 lora_model 和 base_model 的类型,会发现它们都是同一个 TransformerDecoder 的实例。(您可以自行验证。)

为什么这很重要?torchtune 可以轻松地直接从我们的 Llama2 模型加载 LoRA 的检查点,无需任何包装器或自定义检查点转换逻辑。

# Assuming that base_model already has the pretrained Llama2 weights,

# this will directly load them into your LoRA model without any conversion necessary.

lora_model.load_state_dict(base_model.state_dict(), strict=False)

注意

每当使用 strict=False 加载权重时,您都应该验证加载的 state_dict 中是否有任何缺失或额外的键,并确保它们符合预期。torchtune 的 LoRA 范例默认通过 validate_missing_and_unexpected_for_lora() 来执行此操作。

加载基础模型权重后,我们还需要将仅 LoRA 参数设置为可训练。

from torchtune.modules.peft.peft_utils import get_adapter_params, set_trainable_params

# Fetch all params from the model that are associated with LoRA.

lora_params = get_adapter_params(lora_model)

# Set requires_grad=True on lora_params, and requires_grad=False on all others.

set_trainable_params(lora_model, lora_params)

# Print the total number of parameters

total_params = sum([p.numel() for p in lora_model.parameters()])

trainable_params = sum([p.numel() for p in lora_model.parameters() if p.requires_grad])

print(

f"""

{total_params} total params,

{trainable_params}" trainable params,

{(100.0 * trainable_params / total_params):.2f}% of all params are trainable.

"""

)

6742609920 total params,

4194304 trainable params,

0.06% of all params are trainable.

注意

如果您直接使用 LoRA 范例(详见此处),您只需传入相关的检查点路径即可。加载模型权重和设置可训练参数将在范例中处理。

torchtune 中的 LoRA 微调范例¶

最后,我们可以将所有内容组合起来,使用 torchtune 的 LoRA 范例对模型进行微调。请确保您已首先按照这些说明下载了 Llama2 权重和分词器。然后,您可以运行以下命令,使用两块 GPU(每块至少有 16GB 显存)执行 Llama2-7B 的 LoRA 微调

tune run --nnodes 1 --nproc_per_node 2 lora_finetune_distributed --config llama2/7B_lora

注意

请确保指向您的 Llama2 权重和分词器的位置。这可以通过添加 checkpointer.checkpoint_files=[my_model_checkpoint_path] tokenizer_checkpoint=my_tokenizer_checkpoint_path 或直接修改 7B_lora.yaml 文件来完成。有关如何轻松克隆和修改 torchtune 配置的更多详细信息,请参阅我们的“关于配置的一切”范例。

注意

您可以根据 (a) 您拥有的 GPU 数量和 (b) 您硬件的内存限制来修改 nproc_per_node 的值。

前面的命令将使用 torchtune 的出厂设置运行 LoRA 微调,但我们可能想尝试一下。让我们更仔细地看看 lora_finetune_distributed 配置的一些内容。

# Model Arguments

model:

_component_: lora_llama2_7b

lora_attn_modules: ['q_proj', 'v_proj']

lora_rank: 8

lora_alpha: 16

...

我们看到默认设置是将 LoRA 应用于秩为 8 的 Q 和 V 投影。一些关于 LoRA 的实验发现,将 LoRA 应用于自注意力中的所有线性层并将秩增加到 16 或 32 可能是有益的。请注意,这可能会增加我们的最大内存,但只要我们保持 rank<<embed_dim,影响应该是相对较小的。

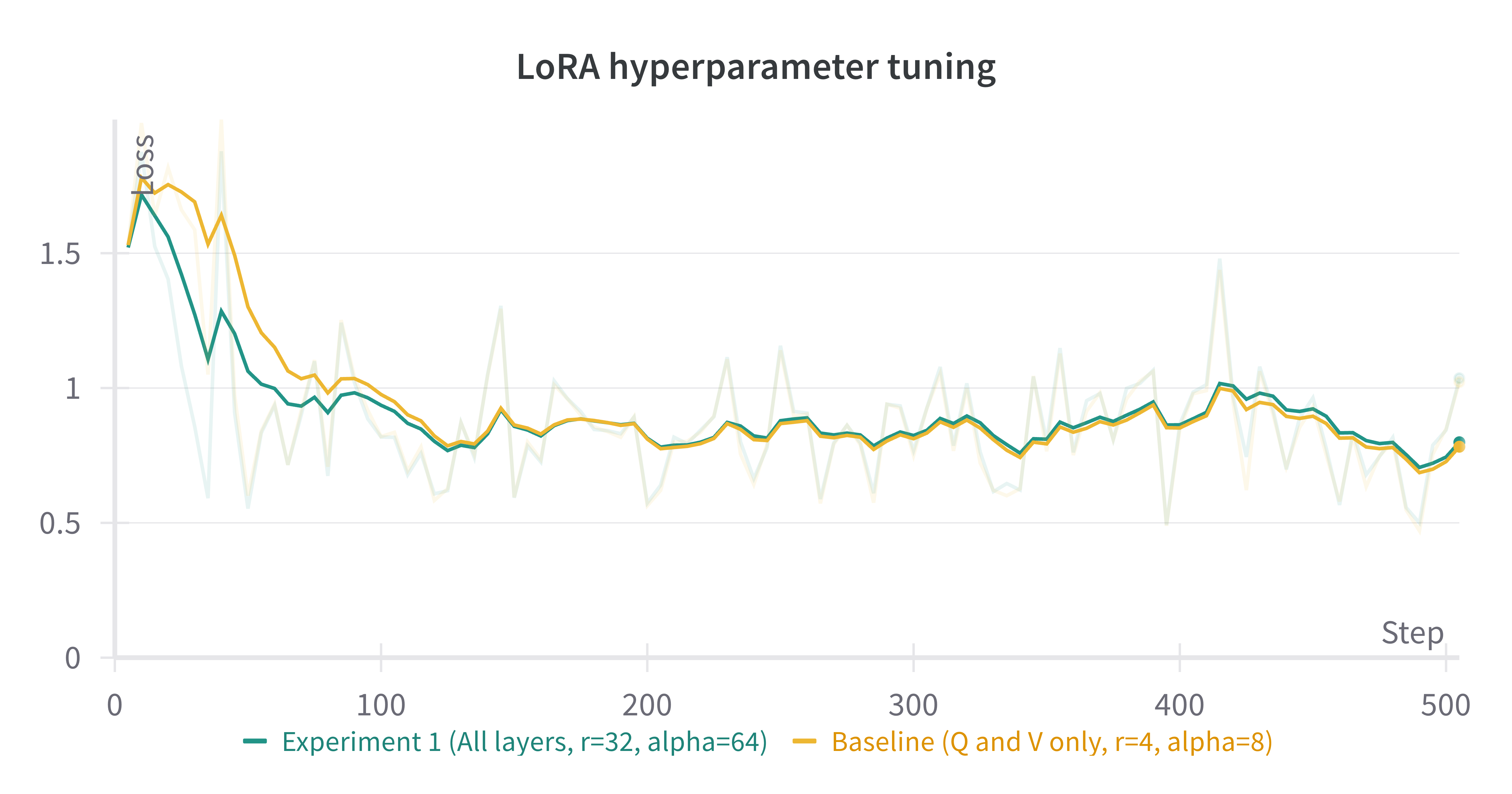

让我们运行这个实验。我们还可以增加 alpha(一般来说,将 alpha 和秩一起缩放是一个好习惯)。

tune run --nnodes 1 --nproc_per_node 2 lora_finetune_distributed --config llama2/7B_lora \

lora_attn_modules=['q_proj','k_proj','v_proj','output_proj'] \

lora_rank=32 lora_alpha=64 output_dir=./lora_experiment_1

下面可以看到本次运行与我们基线在前 500 步期间的(平滑)损失曲线比较。

注意

上图由 W&B 生成。您可以使用 torchtune 的 WandBLogger 生成类似的损失曲线,但您需要单独安装 W&B 并设置帐户。有关在 torchtune 中使用 W&B 的更多详细信息,请参阅我们的“记录到 Weights & Biases”范例。

使用 LoRA 在内存和模型性能之间进行权衡¶

在前面的示例中,我们在两台设备上运行了 LoRA。但是考虑到 LoRA 的低内存占用,我们可以使用大多数支持 bfloat16 浮点格式的商用 GPU 在单台设备上运行微调。这可以通过以下命令完成

tune run lora_finetune_single_device --config llama2/7B_lora_single_device

在单台设备上,我们可能需要更关注我们的峰值内存。让我们运行一些实验来查看微调期间的峰值内存。我们将沿着两个轴进行实验:首先是应用 LoRA 的模型层,其次是每个 LoRA 层的秩。(我们将像前面讨论的那样,将 alpha 与 LoRA 秩同步缩放。)

为了比较我们实验的结果,我们可以在 truthfulqa_mc2 上评估我们的模型,这是语言模型 TruthfulQA 基准测试中的一个任务。有关如何使用 torchtune 集成的 EleutherAI 评估 harness 运行此任务和其他评估任务的更多详细信息,请参阅我们的端到端工作流程教程。

之前,我们只为每个自注意力模块中的线性层启用了 LoRA,但实际上还有其他线性层可以应用 LoRA:MLP 层和我们模型的最终输出投影。请注意,对于 Llama-2-7B,最终输出投影映射到词汇维度(32000 而不是像其他线性层那样的 4096),因此为这一层启用 LoRA 会比其他层稍微增加更多峰值内存。我们可以对配置进行以下更改

# Model Arguments

model:

_component_: lora_llama2_7b

lora_attn_modules: ['q_proj', 'k_proj', 'v_proj', 'output_proj']

apply_lora_to_mlp: True

apply_lora_to_output: True

...

注意

下面所有的微调运行都使用 llama2/7B_lora_single_device 配置,其默认批处理大小为 2。修改批处理大小(或其他超参数,例如优化器)会影响峰值内存和最终评估结果。

LoRA 层 |

秩 |

Alpha |

峰值内存 |

准确率 (truthfulqa_mc2) |

|---|---|---|---|---|

仅 Q 和 V |

8 |

16 |

15.57 GB |

0.475 |

所有层 |

8 |

16 |

15.87 GB |

0.508 |

仅 Q 和 V |

64 |

128 |

15.86 GB |

0.504 |

所有层 |

64 |

128 |

17.04 GB |

0.514 |

我们可以看到,我们的基线设置提供了最低的峰值内存,但我们的评估性能相对较低。通过为所有线性层启用 LoRA 并将秩增加到 64,我们看到在此任务上的准确率绝对提高了近 4%,但峰值内存也增加了约 1.4GB。这些只是几个简单的实验;我们鼓励您运行自己的微调以找到适合您特定设置的权衡方案。

此外,如果您想进一步降低模型的峰值内存(并且仍有可能获得相似的模型质量结果),您可以查看我们的QLoRA 教程。