fasterrcnn_resnet50_fpn¶

- torchvision.models.detection.fasterrcnn_resnet50_fpn(*, weights: Optional[FasterRCNN_ResNet50_FPN_Weights] = None, progress: bool = True, num_classes: Optional[int] = None, weights_backbone: Optional[ResNet50_Weights] = ResNet50_Weights.IMAGENET1K_V1, trainable_backbone_layers: Optional[int] = None, **kwargs: Any) FasterRCNN[来源]¶

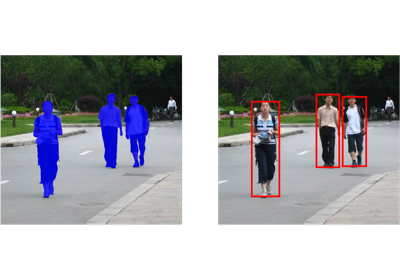

基于 ResNet-50-FPN 主干网络的 Faster R-CNN 模型,出自论文Faster R-CNN: Towards Real-Time Object Detection with Region Proposal Networks。

警告

检测模块目前处于 Beta 阶段,不保证向后兼容性。

模型的输入应为张量列表,每个张量的形状为

[C, H, W],对应每张图像,且值应在0-1范围内。不同图像可以有不同尺寸。模型的行为会根据其处于训练模式还是评估模式而改变。

训练期间,模型期望输入张量以及一个目标(字典列表),包含:

boxes (

FloatTensor[N, 4]): 真实边界框,格式为[x1, y1, x2, y2],其中0 <= x1 < x2 <= W且0 <= y1 < y2 <= H。labels (

Int64Tensor[N]): 每个真实边界框的类别标签

训练期间,模型返回一个

Dict[Tensor],包含 RPN 和 R-CNN 的分类和回归损失。推理期间,模型只需要输入张量,并返回后处理的预测结果,格式为

List[Dict[Tensor]],每个输入图像对应一个。该Dict的字段如下所示,其中N是检测到的数量:boxes (

FloatTensor[N, 4]): 预测的边界框,格式为[x1, y1, x2, y2],其中0 <= x1 < x2 <= W且0 <= y1 < y2 <= H。labels (

Int64Tensor[N]): 每个检测结果的预测标签scores (

Tensor[N]): 每个检测结果的置信度得分

有关输出的更多详细信息,请参阅实例分割模型。

Faster R-CNN 可以导出为 ONNX 格式,适用于固定批量大小和固定尺寸的输入图像。

示例

>>> model = torchvision.models.detection.fasterrcnn_resnet50_fpn(weights=FasterRCNN_ResNet50_FPN_Weights.DEFAULT) >>> # For training >>> images, boxes = torch.rand(4, 3, 600, 1200), torch.rand(4, 11, 4) >>> boxes[:, :, 2:4] = boxes[:, :, 0:2] + boxes[:, :, 2:4] >>> labels = torch.randint(1, 91, (4, 11)) >>> images = list(image for image in images) >>> targets = [] >>> for i in range(len(images)): >>> d = {} >>> d['boxes'] = boxes[i] >>> d['labels'] = labels[i] >>> targets.append(d) >>> output = model(images, targets) >>> # For inference >>> model.eval() >>> x = [torch.rand(3, 300, 400), torch.rand(3, 500, 400)] >>> predictions = model(x) >>> >>> # optionally, if you want to export the model to ONNX: >>> torch.onnx.export(model, x, "faster_rcnn.onnx", opset_version = 11)

- 参数:

weights (

FasterRCNN_ResNet50_FPN_Weights, 可选) – 要使用的预训练权重。有关更多详细信息和可能的值,请参阅下方的FasterRCNN_ResNet50_FPN_Weights。默认情况下,不使用预训练权重。progress (bool, 可选) – 如果为 True,则在标准错误输出中显示下载进度条。默认为 True。

num_classes (int, 可选) – 模型的输出类别数量(包括背景类)

weights_backbone (

ResNet50_Weights, 可选) – 主干网络的预训练权重。trainable_backbone_layers (int, 可选) – 从最后一个块开始计算的可训练(未冻结)层数。有效值在 0 到 5 之间,其中 5 表示所有主干网络层都可训练。如果传入

None(默认值),则该值设为 3。**kwargs – 传递给

torchvision.models.detection.faster_rcnn.FasterRCNN基类的参数。有关此类的更多详细信息,请参阅其源代码。

- class torchvision.models.detection.FasterRCNN_ResNet50_FPN_Weights(value)[来源]¶

上面的模型构建器接受以下值作为

weights参数。FasterRCNN_ResNet50_FPN_Weights.DEFAULT等同于FasterRCNN_ResNet50_FPN_Weights.COCO_V1。您也可以使用字符串,例如weights='DEFAULT'或weights='COCO_V1'。FasterRCNN_ResNet50_FPN_Weights.COCO_V1:

这些权重是通过遵循与论文中相似的训练方案生成的。也可通过

FasterRCNN_ResNet50_FPN_Weights.DEFAULT获取。box_map (在 COCO-val2017 上)

37.0

类别

__background__, person, bicycle, ... (省略 88 项)

最小尺寸

高度=1,宽度=1

参数数量

41755286

方案

GFLOPS

134.38

文件大小

159.7 MB

推理变换可通过

FasterRCNN_ResNet50_FPN_Weights.COCO_V1.transforms获取,并执行以下预处理操作:接受PIL.Image、批量(B, C, H, W)和单张(C, H, W)图像的torch.Tensor对象。图像将被缩放到[0.0, 1.0]范围。

使用

fasterrcnn_resnet50_fpn的示例