SNNMLP

import torch

model = torch.hub.load('huawei-noah/Efficient-AI-Backbones', 'snnmlp_t', pretrained=True)

# or

# model = torch.hub.load('huawei-noah/Efficient-AI-Backbones', 'snnmlp_s', pretrained=True)

# or

# model = torch.hub.load('huawei-noah/Efficient-AI-Backbones', 'snnmlp_b', pretrained=True)

model.eval()

所有预训练模型都要求输入图像以相同的方式进行归一化,即由形状为 (3 x H x W) 的 3 通道 RGB 图像组成的小批量数据,其中 H 和 W 预计至少为 224。图像必须加载到 [0, 1] 范围内,然后使用 mean = [0.485, 0.456, 0.406] 和 std = [0.229, 0.224, 0.225] 进行归一化。

这是一个示例执行。

# Download an example image from the pytorch website

import urllib

url, filename = ("https://github.com/pytorch/hub/raw/master/dog.jpg", "dog.jpg")

try: urllib.URLopener().retrieve(url, filename)

except: urllib.request.urlretrieve(url, filename)

# sample execution (requires torchvision)

from PIL import Image

from torchvision import transforms

input_image = Image.open(filename)

preprocess = transforms.Compose([

transforms.Resize(256),

transforms.CenterCrop(224),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]),

])

input_tensor = preprocess(input_image)

input_batch = input_tensor.unsqueeze(0) # create a mini-batch as expected by the model

# move the input and model to GPU for speed if available

if torch.cuda.is_available():

input_batch = input_batch.to('cuda')

model.to('cuda')

with torch.no_grad():

output = model(input_batch)

# Tensor of shape 1000, with confidence scores over ImageNet's 1000 classes

print(output[0])

# The output has unnormalized scores. To get probabilities, you can run a softmax on it.

print(torch.nn.functional.softmax(output[0], dim=0))

模型描述

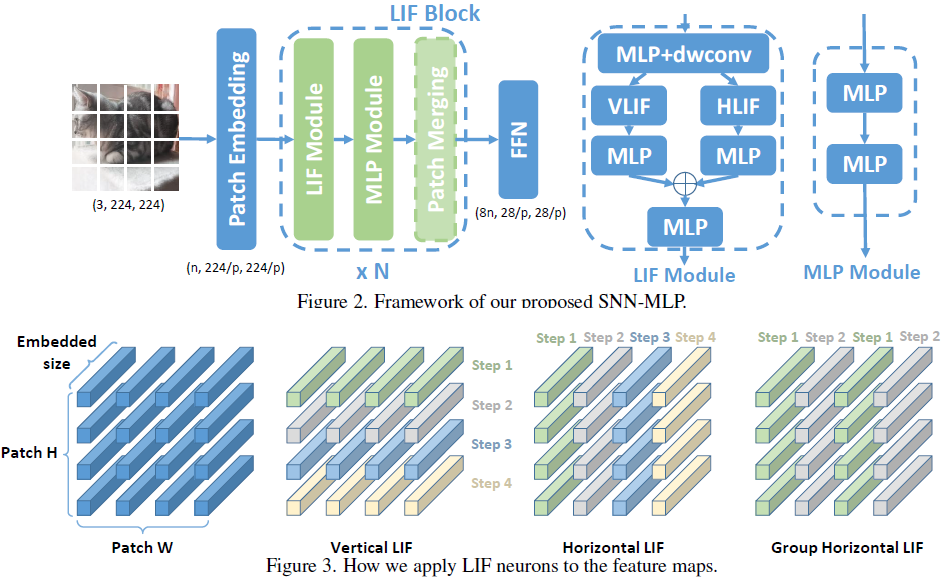

SNNMLP 将 LIF 神经元机制整合到 MLP 模型中,以在不增加额外 FLOPs 的情况下实现更高的准确性。我们提出了一种全精度 LIF 操作,用于在补丁之间进行通信,包括不同方向的水平 LIF 和垂直 LIF。我们还建议使用组 LIF 来提取更好的局部特征。借助 LIF 模块,我们的 SNNMLP 模型在 ImageNet 数据集上分别以仅 4.4G、8.5G 和 15.2G FLOPs 实现了 81.9%、83.3% 和 83.6% 的 Top-1 准确率。

以下列出了预训练模型在 ImageNet 数据集上的相应准确率。

| 模型结构 | #参数 | FLOPs | Top-1 准确率 |

|---|---|---|---|

| SNNMLP Tiny | 28M | 4.4G | 81.88 |

| SNNMLP Small | 50M | 8.5G | 83.30 |

| SNNMLP Base | 88M | 15.2G | 85.59 |

参考文献

您可以在此处阅读完整论文。

@inproceedings{li2022brain,

title={Brain-inspired multilayer perceptron with spiking neurons},

author={Li, Wenshuo and Chen, Hanting and Guo, Jianyuan and Zhang, Ziyang and Wang, Yunhe},

booktitle={Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition},

pages={783--793},

year={2022}

}