今天,我们宣布了 PyTorch 多个库的更新,同时发布了 PyTorch 1.8。这些更新包括 TorchVision、TorchText 和 TorchAudio 等领域库的新版本,以及 TorchCSPRNG 的新版本。这些发布包含许多新功能和改进,与 PyTorch 1.8 一起,为 PyTorch 社区提供了广泛的更新,供其构建和利用。

一些亮点包括:

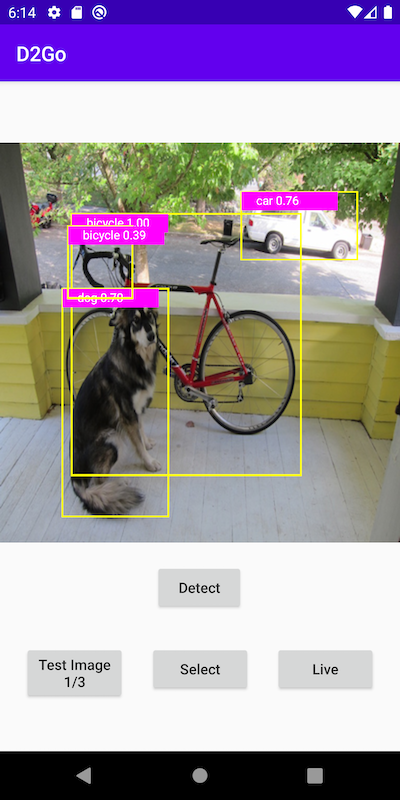

- TorchVision – 添加了对 PyTorch Mobile 的支持,包括 Detectron2Go (D2Go)、训练期间的数据自动增强、即时类型转换和 AMP 自动类型转换。

- TorchAudio – 对 I/O 进行了重大改进,包括默认使用 sox_io 后端和文件类对象支持。添加了 Kaldi 音高特征和对基于 CMake 的构建支持,使 TorchAudio 能够更好地支持非 Python 环境。

- TorchText – 更新了数据集加载 API,使其与标准 PyTorch 数据加载工具兼容。

- TorchCSPRNG – PyTorch 的密码学安全伪随机数生成器现在已稳定,并提供了用于 AES128 ECB/CTR 的新 API 和对 Windows 上 CUDA 的支持。

请注意,从 PyTorch 1.6 开始,功能分为稳定版 (Stable)、测试版 (Beta) 和原型版 (Prototype)。原型版功能不作为二进制分发的一部分,而是通过从源代码构建、使用每夜构建版本或通过编译器标志提供。您可以在此处查看详细公告。

TorchVision 0.9.0

[稳定版] TorchVision Mobile:运算符、Android 二进制文件和教程

我们很高兴宣布 PyTorch 领域库首次支持设备端和二进制文件。我们看到研究和工业界对设备端视觉支持有很大需求,以实现低延迟、隐私友好和资源高效的移动视觉体验。您可以按照此新教程,使用 TorchVision 运算符、D2Go 或您自己的自定义运算符和模型构建自己的 Android 对象检测应用程序。

[稳定版] 用于分类、对象检测和语义分割的新移动模型

我们增加了对 MobileNetV3 架构的支持,并为分类、对象检测和分割提供了预训练权重。使用这些模型很容易上手,只需像导入和加载任何 torchvision 模型一样导入和加载它们即可。

import torch

import torchvision

# Classification

x = torch.rand(1, 3, 224, 224)

m_classifier = torchvision.models.mobilenet_v3_large(pretrained=True)

m_classifier.eval()

predictions = m_classifier(x)

# Quantized Classification

x = torch.rand(1, 3, 224, 224)

m_classifier = torchvision.models.quantization.mobilenet_v3_large(pretrained=True)

m_classifier.eval()

predictions = m_classifier(x)

# Object Detection: Highly Accurate High Resolution Mobile Model

x = [torch.rand(3, 300, 400), torch.rand(3, 500, 400)]

m_detector = torchvision.models.detection.fasterrcnn_mobilenet_v3_large_fpn(pretrained=True)

m_detector.eval()

predictions = m_detector(x)

# Semantic Segmentation: Highly Accurate Mobile Model

x = torch.rand(1, 3, 520, 520)

m_segmenter = torchvision.models.segmentation.deeplabv3_mobilenet_v3_large(pretrained=True)

m_segmenter.eval()

predictions = m_segmenter(x)

这些模型在资源效率、速度和准确性方面与 TorchVision 现有模型具有高度竞争力。有关详细的性能指标,请参阅我们的发布说明。

[稳定版] AutoAugment

AutoAugment 是一种常见的数据增强技术,可以提高场景分类模型的准确性。尽管数据增强策略直接与其训练数据集相关联,但经验研究表明,当应用于其他数据集时,ImageNet 策略可提供显著改进。我们已经实现了在以下数据集上学习的 3 种策略:ImageNet、CIFA10 和 SVHN。这些可以单独使用,也可以与现有转换混合搭配使用。

from torchvision import transforms

t = transforms.AutoAugment()

transformed = t(image)

transform=transforms.Compose([

transforms.Resize(256),

transforms.AutoAugment(),

transforms.ToTensor()])

TorchVision 的其他新功能

- [稳定版] io.image 包中的所有读取和解码方法现在都支持:

- PNG 解码期间的调色板、灰度 Alpha 和 RGB Alpha 图像类型。

- 读取期间图像从一种类型即时转换为另一种类型。

- [稳定版] WiderFace 数据集。

- [稳定版] 通过在 RPN 上引入分数阈值,提高了 FasterRCNN 的速度和准确性。

- [稳定版] DeformConv2D 的调制输入。

- [稳定版] 将音频写入视频文件的选项。

- [稳定版] 绘制边界框的实用工具。

- [测试版] 所有运算符都支持自动类型转换。在此处查找完整的 TorchVision 发布说明:此处。

TorchAudio 0.8.0

I/O 改进

我们延续了上一版本的工作,以改进 TorchAudio 的 I/O 支持,包括:

- [稳定版] 将默认后端更改为“sox_io”(适用于 Linux/macOS),并更新“soundfile”后端的接口以与“sox_io”保持一致。旧版后端和接口仍然可用,但不建议使用。

- [稳定版] “sox_io”后端、“soundfile”后端和 sox_effects 中均支持文件类对象。

- [稳定版] 保存时更改格式、编码和每样本位数的新选项。

- [稳定版] “sox_io”后端添加了 GSM、HTK、AMB、AMR-NB 和 AMR-WB 格式支持。

- [测试版] 一个新的

functional.apply_codec函数,可以通过在内存中应用“sox_io”后端支持的音频编解码器来降低音频数据质量。以下是此版本中包含的一些功能示例:

# Load audio over HTTP

with requests.get(URL, stream=True) as response:

waveform, sample_rate = torchaudio.load(response.raw)

# Saving to Bytes buffer as 32-bit floating-point PCM

buffer_ = io.BytesIO()

torchaudio.save(

buffer_, waveform, sample_rate,

format="wav", encoding="PCM_S", bits_per_sample=16)

# Apply effects while loading audio from S3

client = boto3.client('s3')

response = client.get_object(Bucket=S3_BUCKET, Key=S3_KEY)

waveform, sample_rate = torchaudio.sox_effects.apply_effect_file(

response['Body'],

[["lowpass", "-1", "300"], ["rate", "8000"]])

# Apply GSM codec to Tensor

encoded = torchaudio.functional.apply_codec(

waveform, sample_rate, format="gsm")

查看更新后的音频预处理教程:使用 TorchAudio 进行音频操作。

[稳定版] 切换到基于 CMake 的构建

在 TorchAudio 的上一版本中,它利用 CMake 构建第三方依赖项。从 0.8.0 开始,TorchAudio 使用 CMake 构建其 C++ 扩展。这将为将 TorchAudio 集成到非 Python 环境(例如 C++ 应用程序和移动设备)中打开大门。我们将继续致力于添加示例应用程序和移动集成。

[测试版] 改进和新增的音频转换

此版本中添加了两个广泛请求的运算符:SpectralCentroid 转换和 Kaldi 音高特征提取(详见“A pitch extraction algorithm tuned for automatic speech recognition”)。我们还为 Mel 转换公开了归一化方法,并为 Spectrogram 提供了额外的 STFT 参数。我们希望社区继续提出此类核心音频处理功能的功能请求!

社区贡献

此版本中,开放源代码社区的贡献比以往任何时候都多,包括几个全新的功能。我们衷心感谢社区。请查看新添加的CONTRIBUTING.md,了解贡献代码的方式,请记住报告错误和请求功能同样有价值。我们将继续发布标记为“help-wanted”和“contributions-welcome”的、范围明确的工作项目作为问题,供任何希望贡献代码的人使用,并乐意指导新贡献者完成贡献过程。

在此处查找完整的 TorchAudio 发布说明:此处。

TorchText 0.9.0

[测试版] 数据集 API 更新

在此版本中,我们正在更新 TorchText 的数据集 API,使其与 PyTorch 数据实用程序(例如 DataLoader)兼容,并弃用 TorchText 的自定义数据抽象(例如 Field)。更新后的数据集是数据上简单的逐字符串迭代器。有关从旧版抽象迁移到使用现代 PyTorch 数据实用程序的指南,请参阅我们的迁移指南。

以下文本数据集已作为此工作的一部分进行了更新。有关如何使用这些数据集的示例,请参阅我们的端到端文本分类教程。

- 语言建模:WikiText2、WikiText103、PennTreebank、EnWik9

- 文本分类:AG_NEWS、SogouNews、DBpedia、YelpReviewPolarity、YelpReviewFull、YahooAnswers、AmazonReviewPolarity、AmazonReviewFull、IMDB

- 序列标注:UDPOS、CoNLL2000Chunking

- 翻译:IWSLT2016、IWSLT2017

- 问答:SQuAD1、SQuAD2

在此处查找完整的 TorchText 发布说明:此处。

[稳定版] TorchCSPRNG 0.2.0

我们于 2020 年 8 月发布了 TorchCSPRNG,这是一个 PyTorch C++/CUDA 扩展,为 PyTorch 提供密码学安全伪随机数生成器。今天,我们发布了 0.2.0 版本,并将该库指定为稳定版。此版本包括用于 AES128 ECB/CTR 加密/解密的新 API 以及 CUDA 11 和 Windows CUDA 支持。

在此处查找完整的 TorchCSPRNG 发布说明:此处。

感谢您的阅读,如果您对这些更新感到兴奋并希望参与 PyTorch 的未来,我们鼓励您加入讨论论坛并打开 GitHub 问题。

干杯!

PyTorch 团队