Amazon Ads 使用 PyTorch、TorchServe 和 AWS Inferentia 将推理成本降低 71%,并实现规模扩展。

Amazon Ads 帮助公司通过在亚马逊商城内外(包括网站、应用程序和流媒体电视内容)展示广告,在超过 15 个国家/地区建立品牌并与购物者建立联系。各种规模的企业和品牌,包括注册卖家、供应商、图书供应商、Kindle 直接出版 (KDP) 作者、应用程序开发商和代理商,都可以上传自己的广告创意,其中包括图片、视频、音频以及在亚马逊上销售的产品。

为了促进准确、安全和愉快的购物体验,这些广告必须遵守内容准则。例如,广告不能闪烁,产品必须在适当的背景下展示,图片和文字应适合普通受众。为了帮助确保广告符合所需的政策和标准,我们需要开发可扩展的机制和工具。

作为解决方案,我们使用机器学习 (ML) 模型来发现可能需要修改的广告。在过去十年中,随着深度神经网络的蓬勃发展,我们的数据科学团队开始探索更通用的深度学习 (DL) 方法,这些方法能够以最少的人工干预处理文本、图像、音频或视频。为此,我们使用 PyTorch 构建了计算机视觉 (CV) 和自然语言处理 (NLP) 模型,以自动标记可能不符合要求的广告。PyTorch 直观、灵活且用户友好,使我们无缝过渡到使用 DL 模型。在基于 AWS Inferentia 的 Amazon EC2 Inf1 实例上部署这些新模型,而不是在基于 GPU 的实例上部署,使相同工作负载的推理延迟降低了 30%,推理成本降低了 71%。

向深度学习的过渡

我们的机器学习系统将经典模型与词嵌入配对,以评估广告文本。但随着我们的需求不断演变,提交量持续增长,我们需要一种足够灵活的方法来与我们的业务一起扩展。此外,我们的模型必须快速,并在毫秒内提供广告,以提供最佳的客户体验。

在过去十年中,深度学习在许多领域都变得非常流行,包括自然语言、视觉和音频。由于深度神经网络通过许多层传输数据集——逐步提取更高层次的特征——它们可以做出比经典机器学习模型更细微的推断。例如,深度学习模型不仅可以检测被禁止的语言,还可以拒绝发布虚假声明的广告。

此外,深度学习技术是可迁移的——为一项任务训练的模型可以适应执行相关任务。例如,预训练的神经网络可以优化以检测图像中的物体,然后进行微调以识别不允许在广告中显示的特定物体。

深度神经网络可以自动化传统机器学习中两个最耗时的步骤:特征工程和数据标注。与需要探索性数据分析和手工设计特征的传统监督学习方法不同,深度神经网络直接从数据中学习相关特征。深度学习模型还可以分析非结构化数据,如文本和图像,而无需进行机器学习中必需的预处理。深度神经网络可以有效地随着更多数据进行扩展,并且在涉及大型数据集的应用程序中表现尤其出色。

我们选择 PyTorch 来开发我们的模型,因为它帮助我们最大限度地提高了系统的性能。借助 PyTorch,我们可以更好地服务客户,同时利用 Python 最直观的概念。PyTorch 的编程是面向对象的:它将处理函数与其修改的数据分组。因此,我们的代码库是模块化的,我们可以在不同的应用程序中重用代码片段。此外,PyTorch 的急切模式允许循环和控制结构,因此可以在模型中进行更复杂的操作。急切模式使我们能够轻松地对模型进行原型设计和迭代,并且我们可以使用各种数据结构。这种灵活性有助于我们快速更新模型以满足不断变化的业务需求。

“在此之前,我们尝试了其他‘Pythonic’框架,但 PyTorch 在这里显然是我们的赢家。”应用科学家 Yashal Kanungo 说。“使用 PyTorch 很容易,因为它的结构感觉像是 Python 原生编程,数据科学家对此非常熟悉。”

训练管道

如今,我们完全在 PyTorch 中构建文本模型。为了节省时间和金钱,我们通常通过对预训练的 NLP 模型进行微调以进行语言分析来跳过训练的早期阶段。如果我们需要一个新模型来评估图像或视频,我们首先浏览 PyTorch 的 torchvision 库,该库提供用于图像和视频分类、目标检测、实例分割和姿态估计的预训练选项。对于专业任务,我们从头开始构建自定义模型。PyTorch 非常适合此任务,因为急切模式和用户友好的前端使其易于尝试不同的架构。

要了解如何在 PyTorch 中微调神经网络,请前往 本教程。

在开始训练之前,我们会优化模型的超参数,即定义网络架构(例如,隐藏层数量)和训练机制(例如,学习率和批次大小)的变量。选择适当的超参数值至关重要,因为它们将影响模型的训练行为。我们在此步骤中依赖于 AWS ML 平台 SageMaker 中的贝叶斯搜索功能。贝叶斯搜索将超参数调优视为回归问题:它提出可能产生最佳结果的超参数组合,并运行训练作业以测试这些值。每次试验后,回归算法都会确定下一组要测试的超参数值,并且性能会逐步提高。

我们使用 SageMaker Notebooks 对模型进行原型设计和迭代。急切模式通过为每个训练批次构建一个新的计算图来帮助我们快速原型化模型;操作序列可以在每次迭代中更改,以适应不同的数据结构或与中间结果保持一致。这使我们能够在训练期间调整网络而无需从头开始。这些动态图对于基于可变序列长度的递归计算特别有价值,例如使用 NLP 分析的广告中的单词、句子和段落。

当模型架构最终确定后,我们会在 SageMaker 上部署训练作业。PyTorch 通过同时运行多个训练作业来帮助我们更快地开发大型模型。PyTorch 的 分布式数据并行 (DDP) 模块将单个模型复制到 SageMaker 中多个互连的机器上,并且所有进程同时对各自独特的数据集部分执行前向传播。在反向传播期间,该模块会平均所有进程的梯度,因此每个局部模型都使用相同的参数值进行更新。

模型部署管道

当我们在生产环境中部署模型时,我们希望在不影响预测准确性的前提下降低推理成本。PyTorch 的一些功能和 AWS 服务帮助我们解决了这一挑战。

动态图的灵活性丰富了训练,但在部署中我们希望最大限度地提高性能和可移植性。在 PyTorch 中开发 NLP 模型的一个优点是,它们可以通过 TorchScript(一个专门用于 ML 应用程序的 Python 子集)开箱即用地被追踪到静态操作序列。Torchscript 将 PyTorch 模型转换为更高效、对生产更友好的中间表示 (IR) 图,该图易于编译。我们通过模型运行一个示例输入,TorchScript 记录了前向传播期间执行的操作。生成的 IR 图可以在高性能环境中运行,包括 C++ 和其他多线程无 Python 环境,并且诸如操作符融合等优化可以加快运行时速度。

Neuron SDK 和 AWS Inferentia 支持的计算

我们将模型部署在由 AWS Inferentia 提供支持的 Amazon EC2 Inf1 实例上,Inferentia 是亚马逊首款旨在加速深度学习推理工作负载的 ML 芯片。与基于 Amazon EC2 GPU 的实例相比,Inferentia 已证明可将推理成本降低多达 70%。我们使用 AWS Neuron SDK(与 Inferentia 配合使用的一套软件工具)来编译和优化我们的模型,以便在 EC2 Inf1 实例上部署。

以下代码片段展示了如何使用 Neuron 编译 Hugging Face BERT 模型。与 torch.jit.trace() 类似,neuron.trace() 在前向传播期间记录模型在示例输入上的操作,以构建静态 IR 图。

import torch

from transformers import BertModel, BertTokenizer

import torch.neuron

tokenizer = BertTokenizer.from_pretrained("path to saved vocab")

model = BertModel.from_pretrained("path to the saved model", returned_dict=False)

inputs = tokenizer ("sample input", return_tensor="pt")

neuron_model = torch.neuron.trace(model,

example_inputs = (inputs['input_ids'], inputs['attention_mask']),

verbose = 1)

output = neuron_model(*(inputs['input_ids'], inputs['attention_mask']))

自动类型转换和重新校准

在底层,Neuron 通过将模型自动转换为较小的数据类型来优化其性能。默认情况下,大多数应用程序以 32 位单精度浮点 (FP32) 数字格式表示神经网络值。将模型自动转换为 16 位格式(半精度浮点 (FP16) 或 Brain 浮点 (BF16))可减少模型的内存占用和执行时间。在我们的案例中,我们决定使用 FP16 来优化性能,同时保持高精度。

在某些情况下,自动类型转换到较小的数据类型可能会导致模型预测略有不同。为了确保模型的准确性不受影响,Neuron 会比较 FP16 和 FP32 模型的性能指标和预测。当自动类型转换降低模型准确性时,我们可以告诉 Neuron 编译器只将权重和某些数据输入转换为 FP16,而将其余的中间结果保留在 FP32 中。此外,我们通常会使用训练数据运行几次迭代,以重新校准我们自动类型转换的模型。这个过程比原始训练强度要小得多。

部署

为了分析多媒体广告,我们运行一组深度学习模型。所有上传到亚马逊的广告都会通过专门的模型进行运行,这些模型评估其中包含的每种类型的内容:图像、视频和音频、标题、文本、背景,甚至语法、词法和可能不当的语言。我们从这些模型接收到的信号表明广告是否符合我们的标准。

部署和监控多个模型非常复杂,因此我们依赖于 TorchServe,它是 SageMaker 默认的 PyTorch 模型服务库。TorchServe 由 Facebook 的 PyTorch 团队和 AWS 联合开发,旨在简化从原型设计到生产的过渡,它帮助我们大规模部署训练好的 PyTorch 模型,而无需编写自定义代码。它提供了一组安全的 REST API,用于推理、管理、指标和解释。凭借多模型服务、模型版本控制、集成支持和自动批处理等功能,TorchServe 非常适合支持我们庞大的工作负载。您可以在这篇 博客文章 中阅读更多关于使用 Amazon SageMaker 原生 TorchServe 集成在 SageMaker 上部署您的 Pytorch 模型的信息。

在某些用例中,我们利用 PyTorch 的面向对象编程范式,将多个深度学习模型封装到一个父对象中——一个 PyTorch nn.Module——并将其作为单个集成进行服务。在其他情况下,我们使用 TorchServe 在独立的 SageMaker 端点上服务单个模型,这些端点运行在 AWS Inf1 实例上。

自定义处理程序

我们特别欣赏 TorchServe 允许我们将模型初始化、预处理、推理和后处理代码嵌入到单个 Python 脚本 handler.py 中,该脚本位于服务器上。这个脚本——处理程序——预处理来自广告的未标记数据,通过我们的模型运行这些数据,并将产生的推理结果传递给下游系统。TorchServe 提供了几个默认处理程序,用于加载权重和架构,并准备模型以在特定设备上运行。我们可以将所有其他必需的工件(例如词汇文件或标签映射)与模型捆绑在一个存档文件中。

当我们需要部署具有复杂初始化过程或源自第三方库的模型时,我们会在 TorchServe 中设计自定义处理程序。这些处理程序允许我们加载来自任何库的任何模型,并使用任何必需的进程。以下代码片段展示了一个简单的处理程序,可以在任何 SageMaker 托管端点实例上服务 Hugging Face BERT 模型。

import torch

import torch.neuron

from ts.torch_handler.base_handler import BaseHandler

import transformers

from transformers import AutoModelForSequenceClassification,AutoTokenizer

class MyModelHandler(BaseHandler):

def initialize(self, context):

self.manifest = ctx.manifest

properties = ctx.system_properties

model_dir = properties.get("model_dir")

serialized_file = self.manifest["model"]["serializedFile"]

model_pt_path = os.path.join(model_dir, serialized_file)

self.tokenizer = AutoTokenizer.from_pretrained(

model_dir, do_lower_case=True

)

self.model = AutoModelForSequenceClassification.from_pretrained(

model_dir

)

def preprocess(self, data):

input_text = data.get("data")

if input_text is None:

input_text = data.get("body")

inputs = self.tokenizer.encode_plus(input_text, max_length=int(max_length), pad_to_max_length=True, add_special_tokens=True, return_tensors='pt')

return inputs

def inference(self,inputs):

predictions = self.model(**inputs)

return predictions

def postprocess(self, output):

return output

批处理

硬件加速器针对并行性进行了优化,而批处理——在单个步骤中向模型馈送多个输入——有助于饱和所有可用容量,通常会带来更高的吞吐量。然而,过高的批处理大小可能会增加延迟,而吞吐量的改进却很小。尝试不同的批处理大小有助于我们找到模型和硬件加速器的最佳点。我们运行实验来确定模型大小、负载大小和请求流量模式的最佳批处理大小。

Neuron 编译器现在支持可变批处理大小。以前,跟踪模型会硬编码预定义的批处理大小,因此我们必须填充数据,这会浪费计算资源,降低吞吐量,并加剧延迟。Inferentia 经过优化,可最大限度地提高小批处理的吞吐量,通过减轻系统负载来降低延迟。

并行性

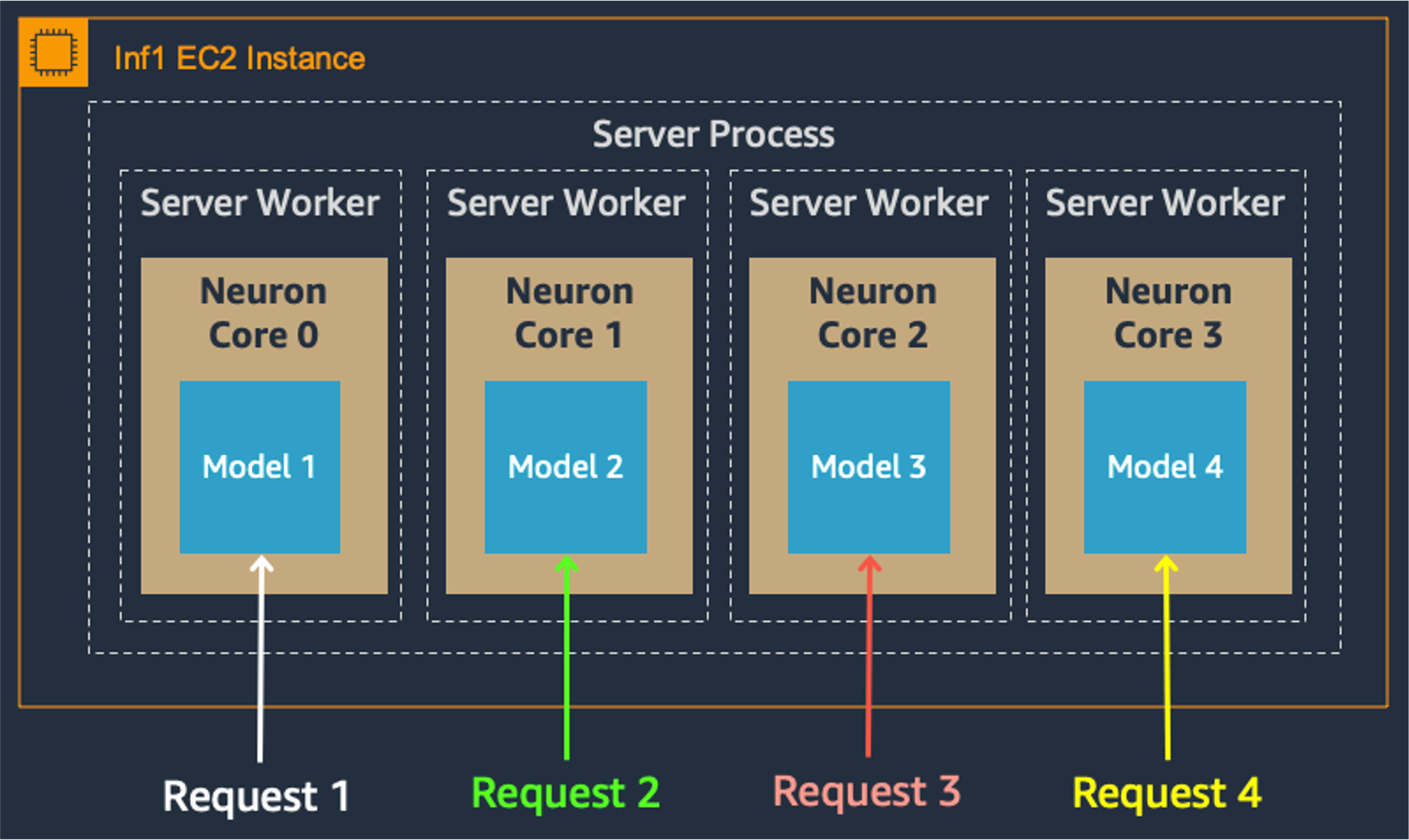

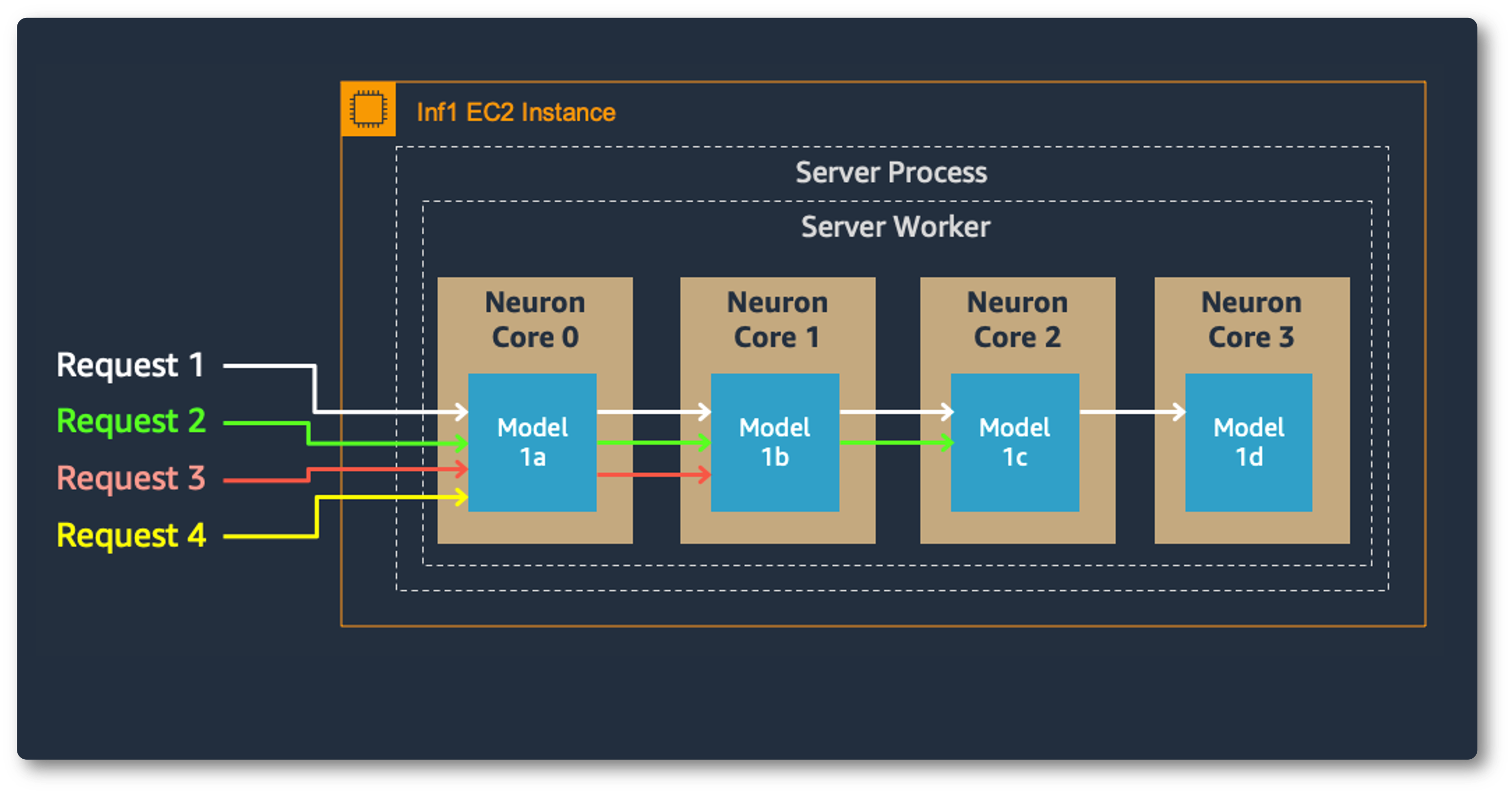

多核模型并行性也改善了吞吐量和延迟,这对于我们繁重的工作负载至关重要。每个 Inferentia 芯片包含四个 NeuronCore,它们可以同时运行单独的模型,也可以形成管道来流式传输单个模型。在我们的用例中,数据并行配置以最低的成本提供最高的吞吐量,因为它扩展了并发处理请求。

数据并行

模型并行

监控

至关重要的是,我们必须监控生产环境中推理的准确性。最初做出良好预测的模型最终可能会在部署中退化,因为它们会暴露于更广泛的数据中。这种现象称为模型漂移,通常发生在输入数据分布或预测目标发生变化时。

我们使用 SageMaker Model Monitor 来跟踪训练数据和生产数据之间的一致性。当生产中的预测开始偏离训练和验证结果时,Model Monitor 会通知我们。得益于这一早期预警,我们可以在广告商受到影响之前恢复准确性——必要时通过重新训练模型。为了实时跟踪性能,Model Monitor 还会向我们发送有关预测质量的指标,例如准确率、F 值和预测类别的分布。

为了确定我们的应用程序是否需要扩展,TorchServe 会定期记录 CPU、内存和磁盘的资源利用率指标;它还会记录收到的请求数量与已服务的请求数量。对于自定义指标,TorchServe 提供了一个 Metrics API。

令人欣喜的成果

我们的深度学习模型,使用 PyTorch 开发并部署在 Inferentia 上,加速了我们的广告分析,同时降低了成本。从我们最初探索深度学习开始,用 PyTorch 编程就感觉很自然。其用户友好的功能帮助我们从早期实验到多模态集成的部署都顺利进行。PyTorch 让我们能够快速原型设计和构建模型,这对于我们广告服务的不断发展和扩展至关重要。此外,PyTorch 与 Inferentia 和我们的 AWS ML 堆栈无缝协作。我们期待使用 PyTorch 构建更多用例,以便我们能够继续为客户提供准确的实时结果。