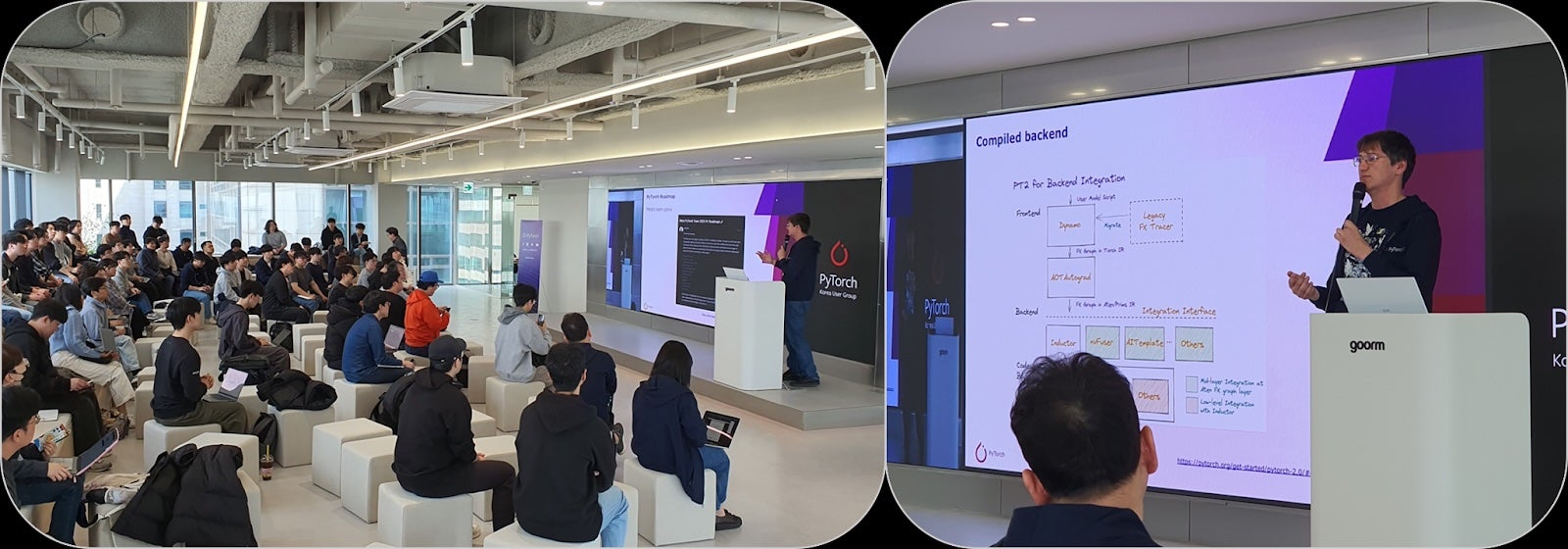

三月底,PyTorch 韩国用户组举办了一场特别的见面会,汇集了杰出演讲者,就 PyTorch 核心及其更广泛的生态系统进行了深入讨论。与以往的聚会相比,本次活动规模扩大了一倍多,我们得以与更多开发者建立联系并分享见解。非常感谢 goorm 赞助了绝佳的场地!😄

本次回顾旨在为未能亲临现场的人以及希望重温当天活力和见解的参与者提供信息。本次活动邀请了 PyTorch 核心、AI 加速器、推理优化和大型语言模型开发领域的专家。以下是本次会议主要环节的快速概览。

1️⃣ Jerry Lee | PyTorch 基金会

作为 Linux 基金会一部分的 PyTorch 基金会代表,Jaeung 概述了 PyTorch 如何推动核心开源技术向前发展。他分享了 PyTorch 的成长故事、目前正在进行的众多全球项目以及该生态系统令人印象深刻的每年 20% 以上的增长。本次会议还涵盖了基金会的运作方式、成员组织的参与方式以及对从业者特别有用的未来计划。

2️⃣ Alban Desmaison | PyTorch 路线图

Alban 分享了 PyTorch 和 Meta 官方贡献路线图 (链接) 背后的设计理念。他深入探讨了 Eager 模式和 Compiled 模式之间的技术差异,特别是详细分解了设备 Eager 执行的后端架构。他还介绍了实用工具和改进,例如内存分析器、增强的自定义运算符支持和固定内存优化。

3️⃣ Hongseok Kim | PyTorch 在 Rebellions AI 加速器上的状态

Rebellions 正在为其专有 NPU 架构构建运行时集成,完全符合 PyTorch 2.0 中的结构变化。本次演讲介绍了他们即将推出的芯片的性能和可扩展性、他们与 PyTorch 运行时的集成策略以及支持 Eager 模式所面临的挑战。Hongseok 还预告了他们将在年内发布这些功能的路线图。

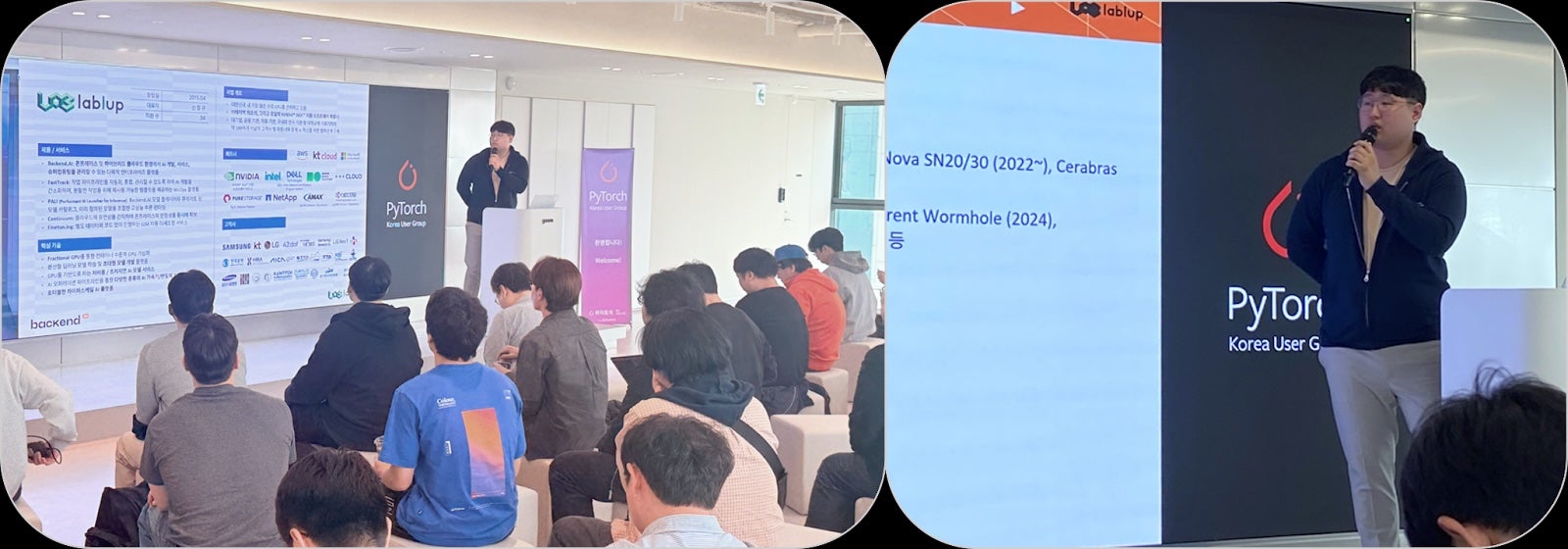

4️⃣ Kyujin Cho | Backend.AI:一个适用于所有 AI 加速器的统一平台

Backend.AI 将各种 AI 加速器抽象并集成到统一的工作流程中。随着加速器架构多样性的增长,对可移植性和基础设施统一的需求变得更加重要。本次会议展示了开发和运维方面的功能——从 NPU 调度和资源分配到监控。Backend.AI 目前支持来自 NVIDIA、Intel、Tenstorrent、Rebellions 等公司的加速器。

5️⃣ Taeho Kim | 使用 NetsPresso 在多个芯片组上优化和部署模型

本次演讲侧重于 AI 模型在实际工业应用中推理所面临的挑战。随着新的最先进模型迅速涌现,对能够快速验证设备兼容性(理想情况下只需一键操作)的环境的需求日益增长。NetsPresso 正在积极开发与 PyTorch 兼容的静态图表示,为模型开发、优化和测试提供高效支持。

6️⃣ Jungyeop Lee | 复现 Deepseek-R1 的历程

Jungyeop 带领我们回顾了他复现大型语言模型 Deepseek 的历程,这项工作涉及 201 次实验。他分享了使用韩语数据进行训练、分词器修改和微调策略的真实经验。他的实用见解和后续步骤对于那些从头开始构建或重新实现大型模型的人来说尤其有价值。

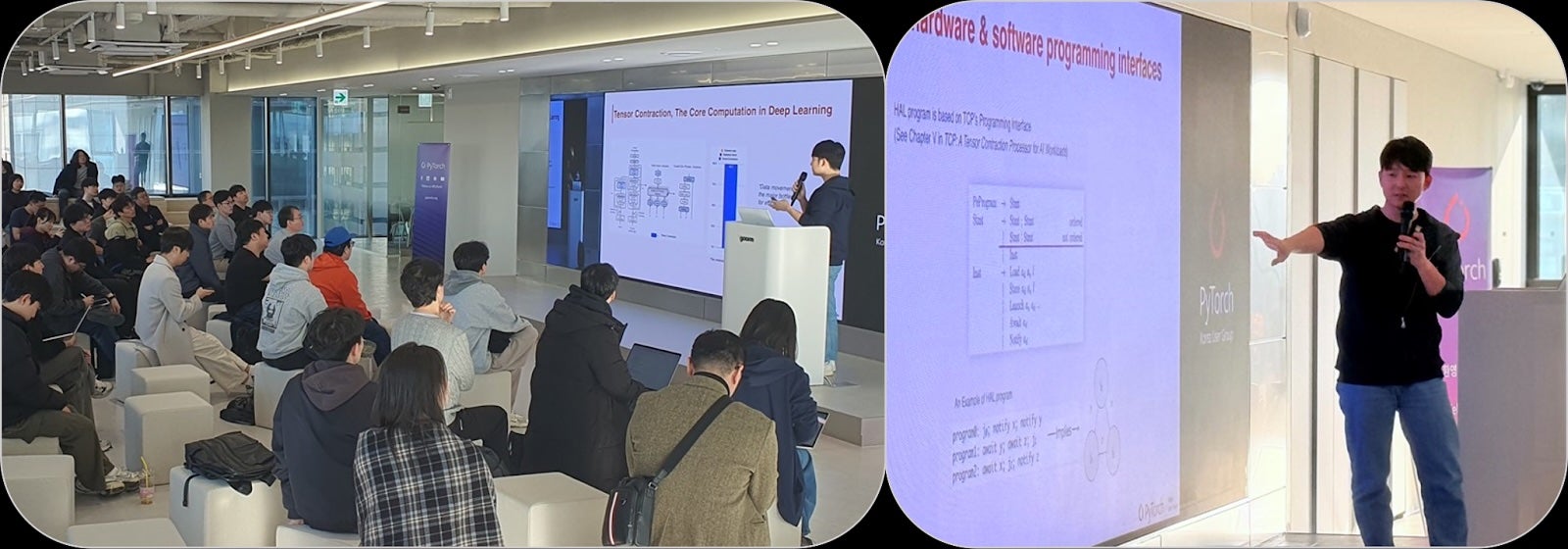

7️⃣ Sol Kim | 从 TCP 架构到生产级 LLM 的旅程

Sol 提出了使用 TCP(张量收缩处理器)架构部署大型模型的集成优化方法,该架构在硬件层面支持张量收缩。本次演讲强调了基于硬件抽象层 (HAL) 的优化技术以及与 PyTorch 的自下而上集成策略——提供了混合硬件-软件视角。

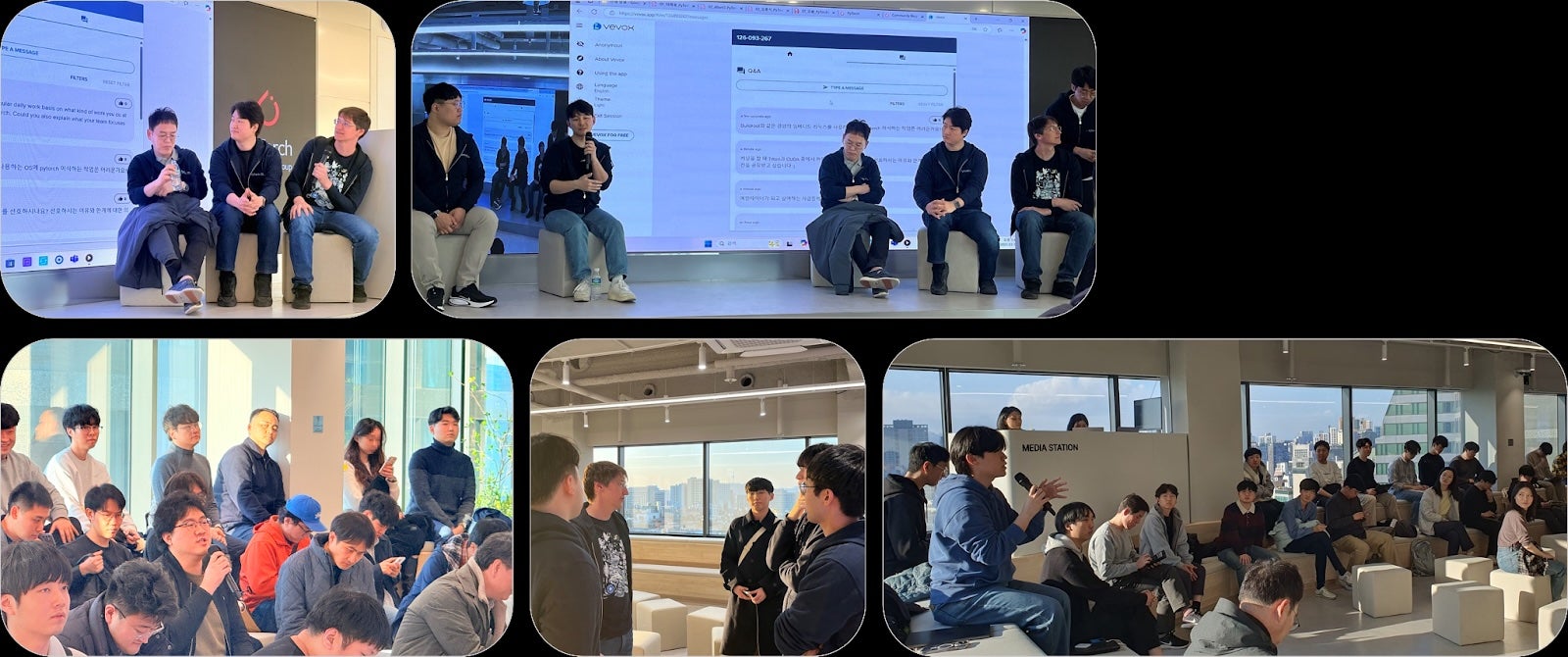

💡 小组讨论与问答 💡

活动以一场引人入胜的小组讨论结束。与会者提出了尖锐的问题,演讲者给出了富有洞察力的答案。这是一个激动人心的时刻,它抓住了社区对 PyTorch 的热情以及他们对更深入技术理解的渴望。

总结

自 2022 年 10 月首次线下见面会以来,PyTorch 韩国用户组已举办了五次大型技术会议。每次活动都加深了我们对 PyTorch 生态系统规模和深度的认识。通过用户、贡献者和生态系统建设者的视角,我们分享的故事只会越来越多——我们致力于继续这段旅程。

下届会议再见——届时将有更精彩的演讲!🙌